小麦产业发展对国家粮食安全和社会稳定具有直接且深远的影响

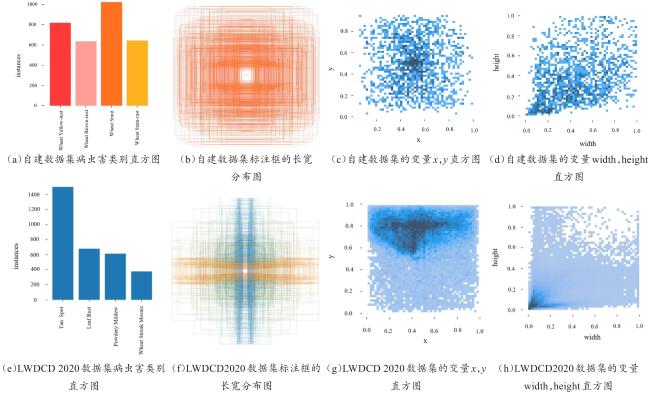

[1]。根据初步统计数据,2022年全国小麦病虫害累计发生面积达到4 166万公顷次,同时防治工作也累计覆盖了7 148万公顷次。从整体角度来看,全国小麦病虫害的发生情况属于中等水平,但部分病虫害在局部地区的发生情况却显得较为严重,尤其是以西北地区最严重,发生种类主要有黄锈病、褐锈病、黑穗病、秆锈病、小麦蚜虫等

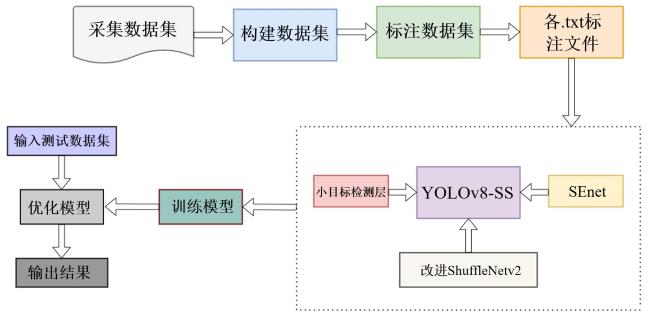

[2]。计算机图像处理技术的迅速发展,为农作物病虫害的识别提供了新的科学途径。例如,在农业生产过程中,使用基于深度学习算法能准确地分析农作物病虫害现状,并做出迅速且准确的反应,在受影响的区域进行精确的农药喷洒,提高农药使用效率

[3]。综观农作物病虫害检测方法的发展历程,可以得出:基于人工的检测方法具有主观性强、效率低且检测准确率低的弊端;基于仪器的检测方法具有自动化及智能化偏低与结果受外界环境等因素影响的局限;基于数理统计的检测方法具有工作量大、使用范围小和需要专业的统计学及农业学相关知识的局限。基于深度学习的检测方法能够自动、高效、准确地从大量农作物病虫害图像中提取病虫害目标特征,代替传统检测方法、辅助农业人员完成农作物预防与治理的潜力。目前,深度学习算法在识别农作物病虫害的准确度和速度方面具有显著优势,众多学者在不断优化和改进这些深度学习算法模型,并尝试将其应用于农作物的病虫害分类检测与识别研究中。Sladojevic等

[4]采用AlexNet

[5]卷积网络开发了一种基于农作物图像分类识别病虫害的新方法,在单独类别测试中,精度达到91%~98%,模型最终总体准确率达到96.3%。张航等

[6]提出了一种面向大规模多类别病虫害检测识别方法,采用卷积神经网络(Convolutional Neural Network, CNN)并利用随机梯度下降法进行优化,通过样本学习获取特征集,并通过该特征集对小麦图片进行病害识别,可有效识别小麦常见的病虫害,综合识别率超过90%。贾少鹏等

[7]提出了一种将CNN与胶囊网络(Capsule Network, CapsNet)

[8]相结合的病虫害检测新模型。该模型在农作物病虫害图像识别准确率达到93.75%,相比传统的CNN模型提高3.55%。Xue等

[9]提出了一种基于改进YOLOv5的茶叶病虫害检测模型YOLO-Tea,用于在自然环境下拍摄的茶树叶片病虫害检测,与YOLOv5s、Faster R-CNN和SSD(Single Shot MultiBox Detector)等模型相比,YOLO-Tea在所有测试数据上提高0.3%~15.0%。Huang等

[10]提出了一种基于知识蒸馏的植物病害检测方法来提高模型检测性能,以实现多种农作物的多种病害的高效诊断,在模型参数较小的PlantDoc数据集中实现了60.4%的mAP@.5,优于现有方法。总体而言,多级知识蒸馏技术可以使模型更轻,同时保持高精度。Jiang等

[11]提出了一种基于多任务学习思想的VGG16(Visual Geometry Group 16)模型,进行改进后再利用ImageNET上的预训练模型进行迁移学习和交替学习。通过对比实验证明,该方法在迁移学习中的效果优于单任务模型、Reuse-Model方法、ResNet50模型和DeneNet121模型,也表明提出的改进VGG16模型和多任务迁移学习方法可以同时识别多种植物叶病害。Dong等

[12]提出了一系列常用的基于植物病害图像的预训练模型PDDD-PreTrain,模型能够以更少的训练时间实现比现有预训练模型更高的准确率。