0 引 言

1 材料与方法

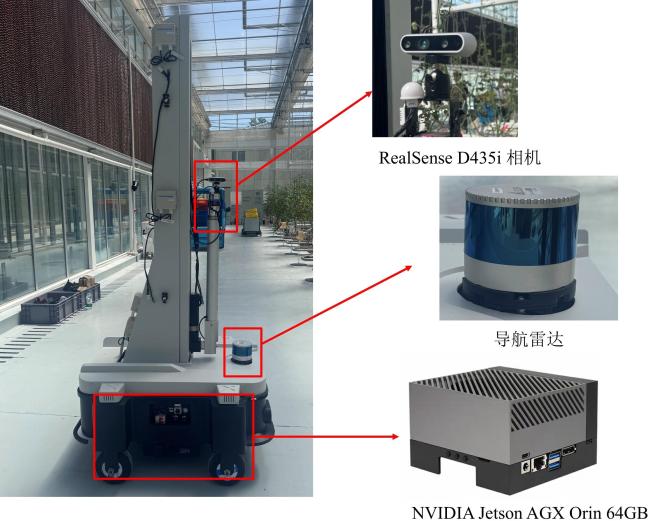

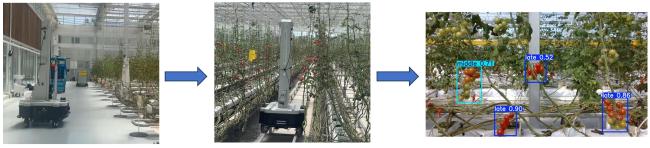

1.1 图像采集

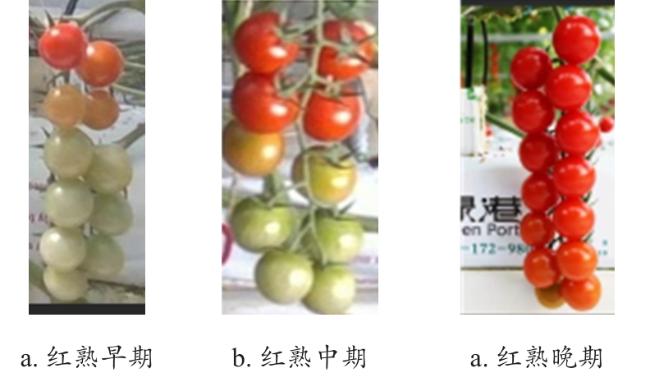

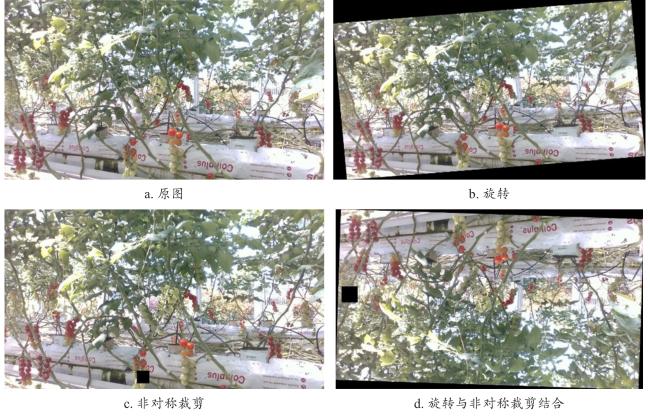

1.2 图像处理

表1 串番茄三类成熟度标注样本数量Table 1 Sample counts for three maturity stages of cluster tomatoes |

| 成熟时期 | 训练集 | 验证集 | 测试集 | 总计(占比/%) |

|---|---|---|---|---|

| 红熟早期 | 93 | 841 | 148 | 1 082(32.07) |

| 红熟中期 | 104 | 934 | 166 | 1 204(35.07) |

| 红熟晚期 | 107 | 831 | 149 | 1 087(32.86) |

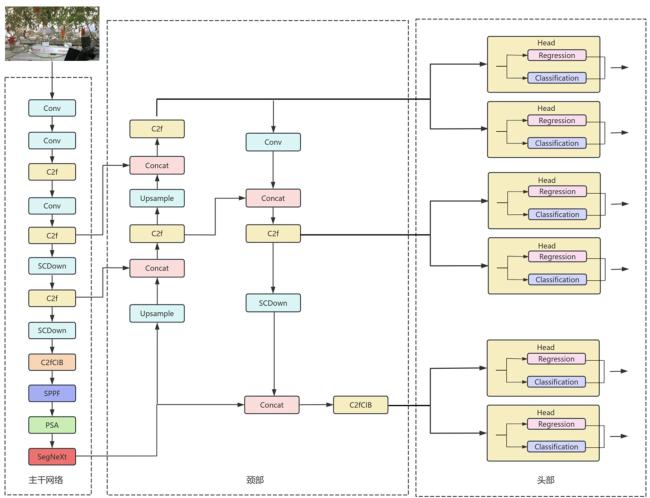

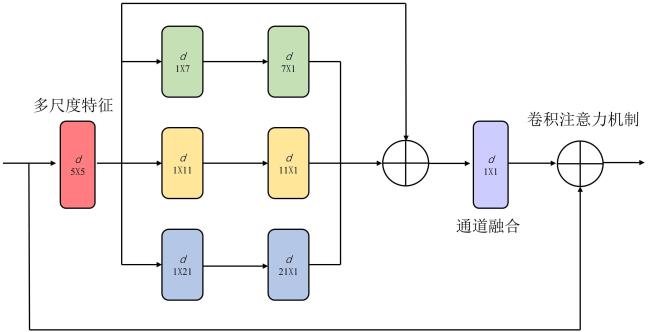

1.3 LampCT-YOLO

1.3.1 LampCT-YOLO模型结构

1.3.2 SegNeXt注意力机制

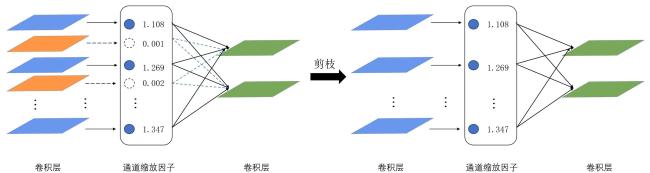

1.3.3 LAMP通道剪枝

1.3.4 评估指标

2 结果与分析

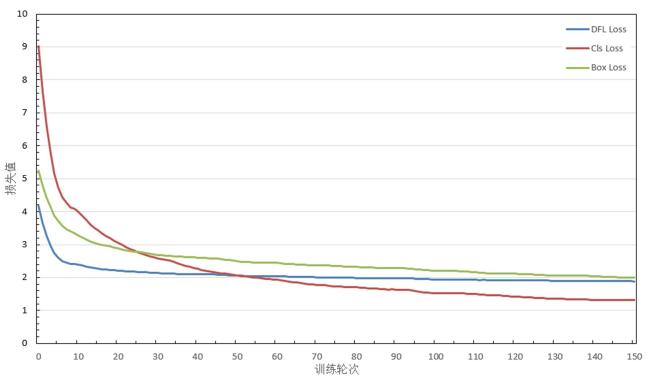

2.1 试验设置

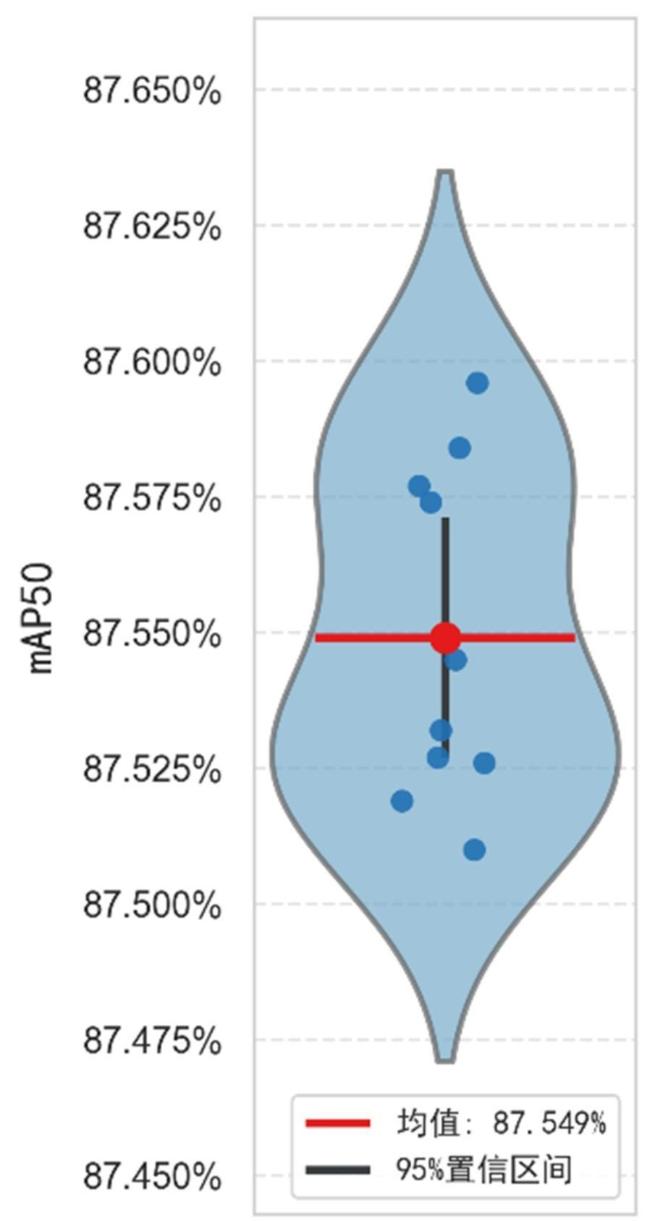

2.2 消融试验

表2 串番茄成熟度检测的SegNeXt注意力机制消融试验Table 2 Ablation experiment of segnext attention mechanism for cluster tomato maturity detection |

| 模型 | 红熟早期/% | 红熟中期/% | 红熟晚期/% | mAP50/% | FPS | 权重文件大小/MB | 参数量/MB | GFLOPs/GB |

|---|---|---|---|---|---|---|---|---|

| YOLOv10 | 79.1 | 81.8 | 87.5 | 82.8 | 37.37 | 107.7 | 45.811 | 106.700 |

| YOLOv10+SegNeXt | 84.6 (+5.5) | 89.5(+7.7) | 88.4(+0.9) | 87.5(+4.7) | 35.8 (-1.57) | 107.6 (-0.1) | 53.522 | 228.765 |

表3 Lamp模型剪枝消融试验Table 3 Ablation experiment on the pruning of the lamp model |

| 模型 | 红熟早期/% | 红熟中期/% | 红熟晚期/% | mAP50/% | FPS | 权重文件大小/MB | 参数量/MB | GFLOPs/GB |

|---|---|---|---|---|---|---|---|---|

| YOLOv10+SegNeXt | 84.6 | 89.5 | 88.4 | 87.5 | 35.8 | 107.6 | 53.5 | 228.7 |

| YOLOv10+SegNeXt +DWConv | 75.4 (-9.2) | 75.0 (-14.5) | 82.2 (-6.2) | 77.5 (-10.0) | 37.7 (+1.9) | 52.2 (-55.5) | 21.1 (-32.4) | 115.2 (-113.5) |

| YOLOv10+SegNeXt +Lamp | 81.4 (-3.2) | 84.3 (-5.2) | 91.9(+3.5) | 85.9 (-1.6) | 66.9 (+23.1) | 40.0 (-67.7) | 19.7 (-33.7) | 114.2 (-114.5) |

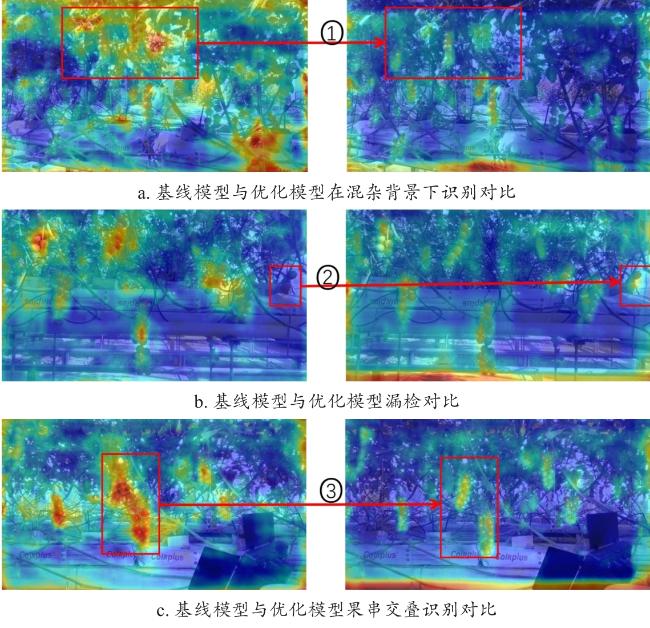

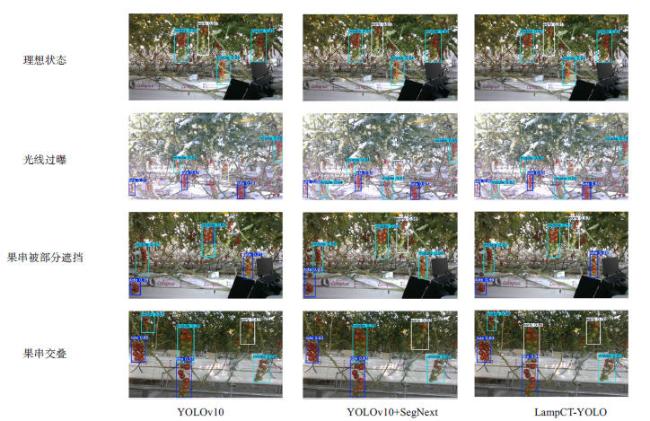

2.3 引入SegNeXt可视化结果对比

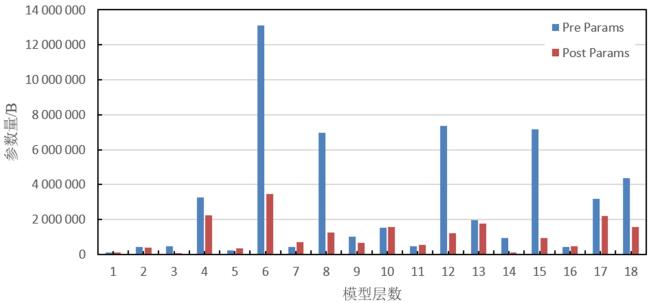

2.4 剪枝试验

2.5 与主流目标检测模型的比较

表4 增加注意力机制后模型与主流目标检测模型比较试验Table 4 Comparison of the attention-enhanced model with mainstream object detection models |

| 模型名称 | mAP50/% | FPS | GFLOPs/G | 模型参数量/MB | 权重文件大小/MB |

|---|---|---|---|---|---|

| SSD | 77.3 | 43.22 | 37.8 | 21.472 | 91.6 |

| Faster RCNN | 80.7 | 15.75 | 177.3 | 115.684 | 108.3 |

| YOLOv7 | 76.0 | 48.25 | 51.6 | 36.490 | 71.3 |

| YOLO8n | 84.5 | 39.89 | 8.1 | 3.006 | 6.3 |

| YOLO8s | 84.0 | 43.82 | 28.4 | 11.127 | 22.5 |

| YOLO8m | 82.5 | 45.41 | 78.7 | 25.841 | 52.0 |

| YOLO8l | 83.6 | 39.91 | 164.8 | 43.609 | 87.7 |

| YOLO8x | 82.4 | 37.54 | 257.4 | 68.126 | 136.7 |

| YOLOv10n | 82.8 | 43.57 | 6.0 | 2.207 | 5.6 |

| YOLOv10s | 81.9 | 44.49 | 21.4 | 7.219 | 16.5 |

| YOLOv10m | 82.5 | 44.57 | 58.9 | 15.315 | 33.5 |

| YOLOv10l | 82.6 | 37.37 | 228.7 | 53.522 | 107.7 |

| YOLOv10x | 79.0 | 41.60 | 160 | 29.399 | 130.4 |

| YOLOv11n | 85.9 | 43.99 | 6.3 | 2.583 | 5.5 |

| YOLOv11s | 85.3 | 43.12 | 21.3 | 9.414 | 19.2 |

| YOLOv11m | 85.3 | 37.89 | 67.7 | 20.032 | 40.5 |

| YOLOv11l | 85.9 | 37.15 | 194.4 | 56.830 | 114.4 |

| YOLOv11x | 84.0 | 37.21 | 194.4 | 58.362 | 114.4 |

| YOLOv12n | 84.1 | 39.71 | 5.8 | 2.509 | 11.2 |

| YOLOv12s | 82.0 | 40.57 | 19.3 | 9.074 | 18.6 |

| YOLOv12m | 84.6 | 41.98 | 59.5 | 17.579 | 39.7 |

| YOLOv12l | 79.9 | 36.23 | 82.1 | 26.396 | 53.7 |

| YOLOv12x | 81.3 | 33.39 | 184.1 | 59.248 | 119.5 |

| YOLOv10 l + SegNeXt | 87.5 | 66.20 | 114.2 | 19.765 | 40.0 |

表5 YOLOv10不同规模模型在SegNeXt与Lamp模块作用下的检测性能分析Table 5 Detection performance analysis of different YOLOv10 models with SegNeXt and Lamp modules |

| 模型名称 | mAP50/% | FPS | GFLOPs/G | 模型参数量/MB | 权重文件大小/MB |

|---|---|---|---|---|---|

| YOLOv10n | 82.8 | 43.57 | 6.000 | 2.207 | 5.6 |

| YOLOv10n+ SegNeXt | 85.5 | 41.50 | 8.600 | 2.450 | 6.3 |

| YOLOv10n+ SegNeXt+Lamp | 84.8 | 51.20 | 6.500 | 2.000 | 5.1 |

| YOLOv10l | 82.6 | 37.37 | 106.700 | 45.811 | 107.7 |

| YOLOv10 l + SegNeXt | 87.5 | 35.80 | 228.765 | 53.522 | 107.6 |

| YOLOv10l+ SegNeXt+Lamp | 85.9 | 66.90 | 114.252 | 19.765 | 40.0 |

2.6 果蔬巡检机器人部署

表6 LampCT-YOLO模型部署移动设备检测结果与人工计数的对比Table 6 Comparison Between Mobile Device Detection Results of the LampCT-YOLO Model and Manual Counts |

| 红熟早期/串 | 红熟中期/串 | 红熟晚期/串 | 误检/串 | 漏检/串 | |

|---|---|---|---|---|---|

| 人工计数 | 92 | 70 | 294 | 0 | 0 |

| 设备检测 | 78 | 61 | 248 | 22 | 47 |