筛选变量的方法可分为三大类:变量优化选择法、变量区间选择法以及变量信息选择法。变量优化选择法通过创造一个合适的目标函数以寻找最优变量组合,主要包括遗传算法(Genetic Algorithm,GA)

[10]、粒子群算法(Particle Swarm Optimization,PSO)

[11]、模拟退火算法(Simulated Annealing Algorithm,SAA)

[12,13]等。变量区间选择法通过筛选多个光谱区间作为有效变量区间组合,区间数目的选择直接影响模型的结果,包括间隔偏最小二乘法(Interval Partial Least Squares,iPLS)

[14]、前向间隔偏最小二乘法(Forward Interval PLS,FiPLS)

[15]、后向间隔偏最小二乘法(Backward Interval PLS,BiPLS)

[16]和移动窗口最小二乘法(Moving Window Partial Least Squares,MWPLS)

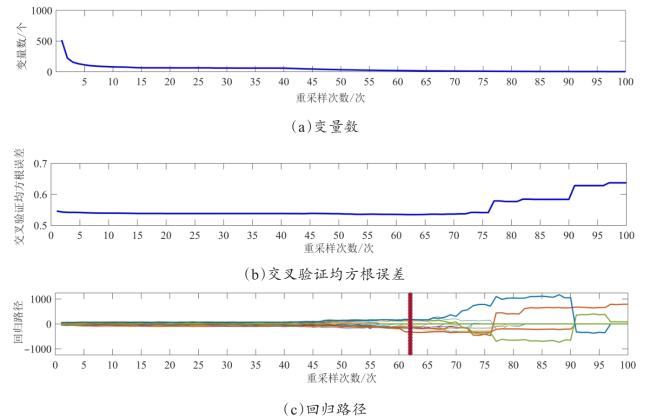

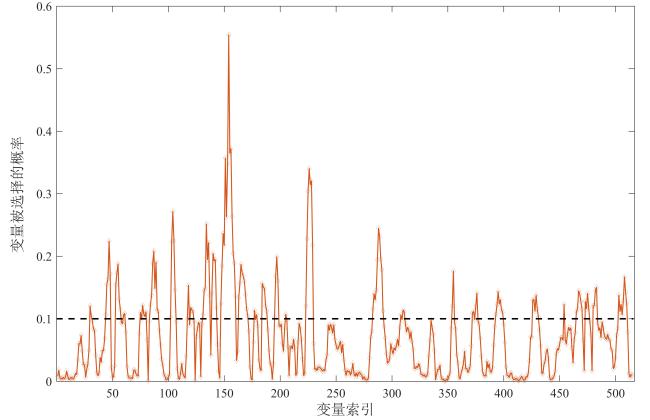

[17,18]。变量信息选择法将信息变量作为描述变量在模型中所起作用大小的指示变量,其中竞争性自适应重加权算法(Competitive Adaptive Reweighted Sampling,CARS)

[19]、无信息变量消除法(Elimination of Uninformative Variables,UVE)

[20]和连续投影法(Successive Projections Algorithm,SPA)

[19]是较为流行的几种算法。另外,一些新型的组合优化算法如随机蛙跳算法(Shuffled Frog Leaping Algorithm,SFLA)

[21,22]被广泛应用于农业工程。此外,主成分分析(Principal Component Analysis,PCA)等算法也用于压缩数据,但一般不用来做直接的特征提取而是用来做特征矩阵的降维

[23]。与CARS、SFLA算法等直接筛选代表性变量相比,主成分各个特征维度的含义具有一定的模糊性,不如原始样本特征的解释性强。