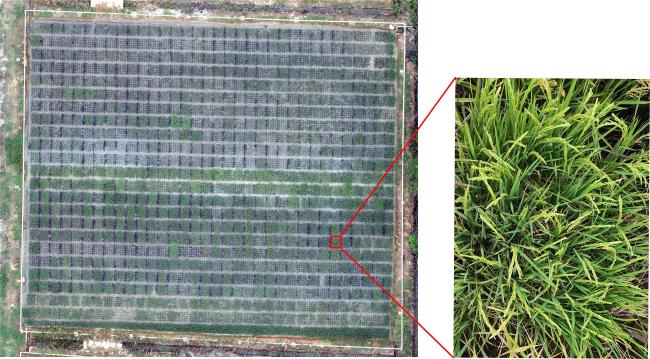

由于水稻成熟期植株间遮挡严重,很难准确识别出全部稻穗,而收获后的茎秆残茬几乎不存在遮挡,可作为水稻有效分蘖计数的有力参考。Jin等

[19]通过更快的基于区域的卷积神经网络(Faster Region-Based Convolutional Neural Network, Faster-RCNN)模型进行收获后小麦分蘖残差的识别检测,识别准确率和召回率接近95%,从而进行穗密度的估计。Deng等

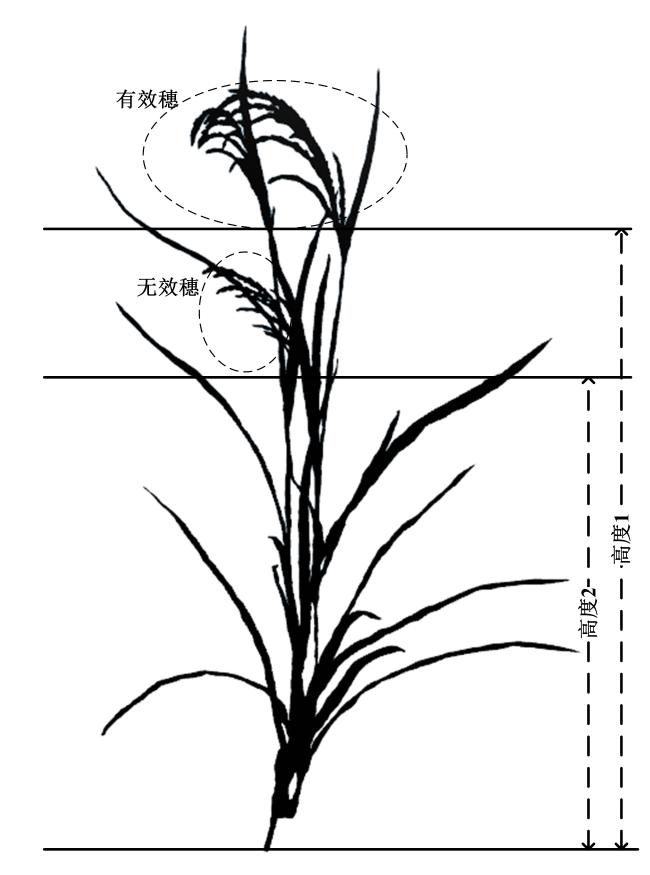

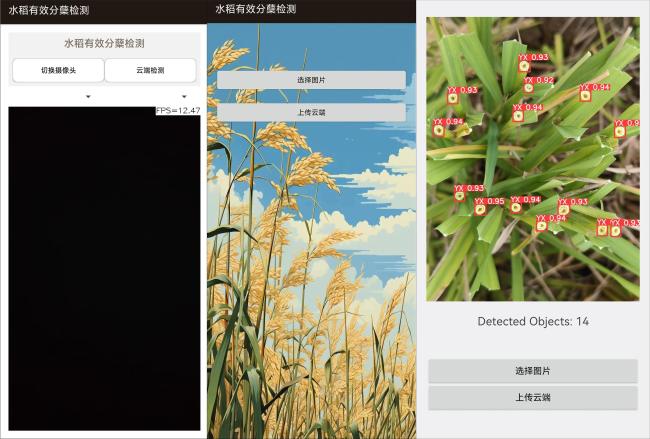

[20]提出了一种基于深度学习卷积网络(Convolutional Neural Networks, CNN)的水稻分蘖自动检测和计数方法,并将该检测方法实现为高通量、低成本的Web应用程序,其检测的准确率超过99%。基于深度学习的图像分析技术在水稻有效分蘖的准确、高效识别和计数方面具有广阔前景。之前研究者通过茎秆计数结果为全部分蘖数,而水稻拥有大量的无效分蘖,为了保证茎秆计数结果为水稻有效分蘖数,就需要区分有效分蘖和无效分蘖。邓奎才

[21]对水稻有效分蘖终止期进行确定,通过时间节点划分有效分蘖和无效分蘖。高美玉

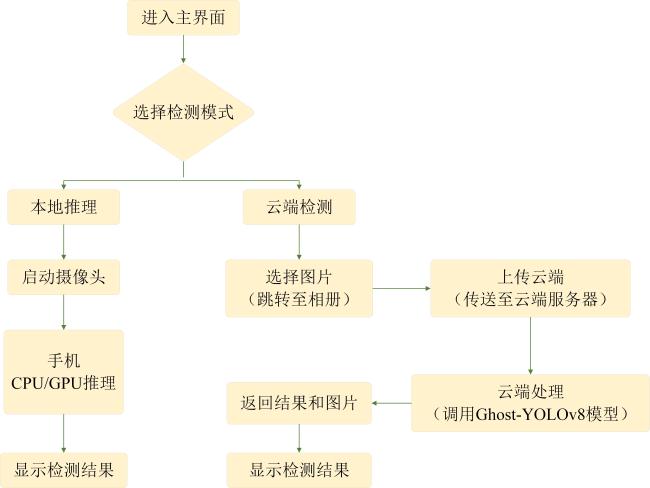

[22]提到可以将苗高率作为水稻有效分蘖和无效分蘖区分标志,即分蘖高峰后的第一个星期,苗高达到该株最长分蘖的三分之二以上的,可判断为有效分蘖。因此,本研究主要针对分蘖高度来划分有效分蘖和无效分蘖,结合深度学习方法进行水稻有效分蘖检测与计数,并将该方法开发为高通量、低成本的水稻有效分蘖检测手机App,解决田间条件下有效分蘖调查的实际问题。