0 引 言

1 材料与方法

1.1 玉米图像数据集

1.2 图像扩增与关键点均匀采样

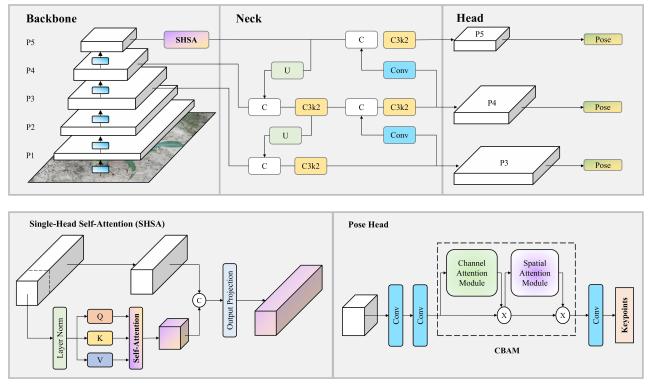

1.3 基于改进YOLOv11-Pose的关键点检测

1.3.1 改进YOLOv11-Pose网络框架

1.3.2 损失函数

1.4 表型参数测量

1.5 评价指标

2 结果与讨论

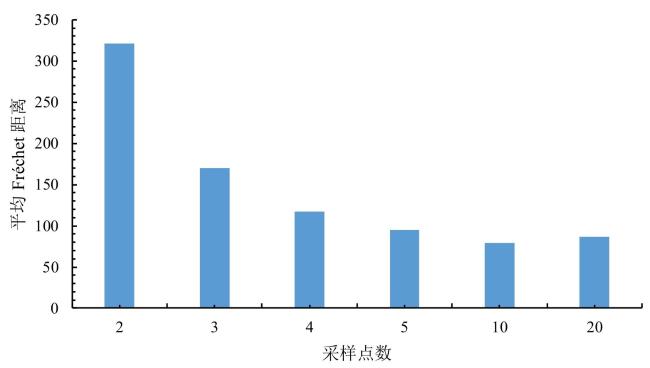

2.1 关键点均匀采样

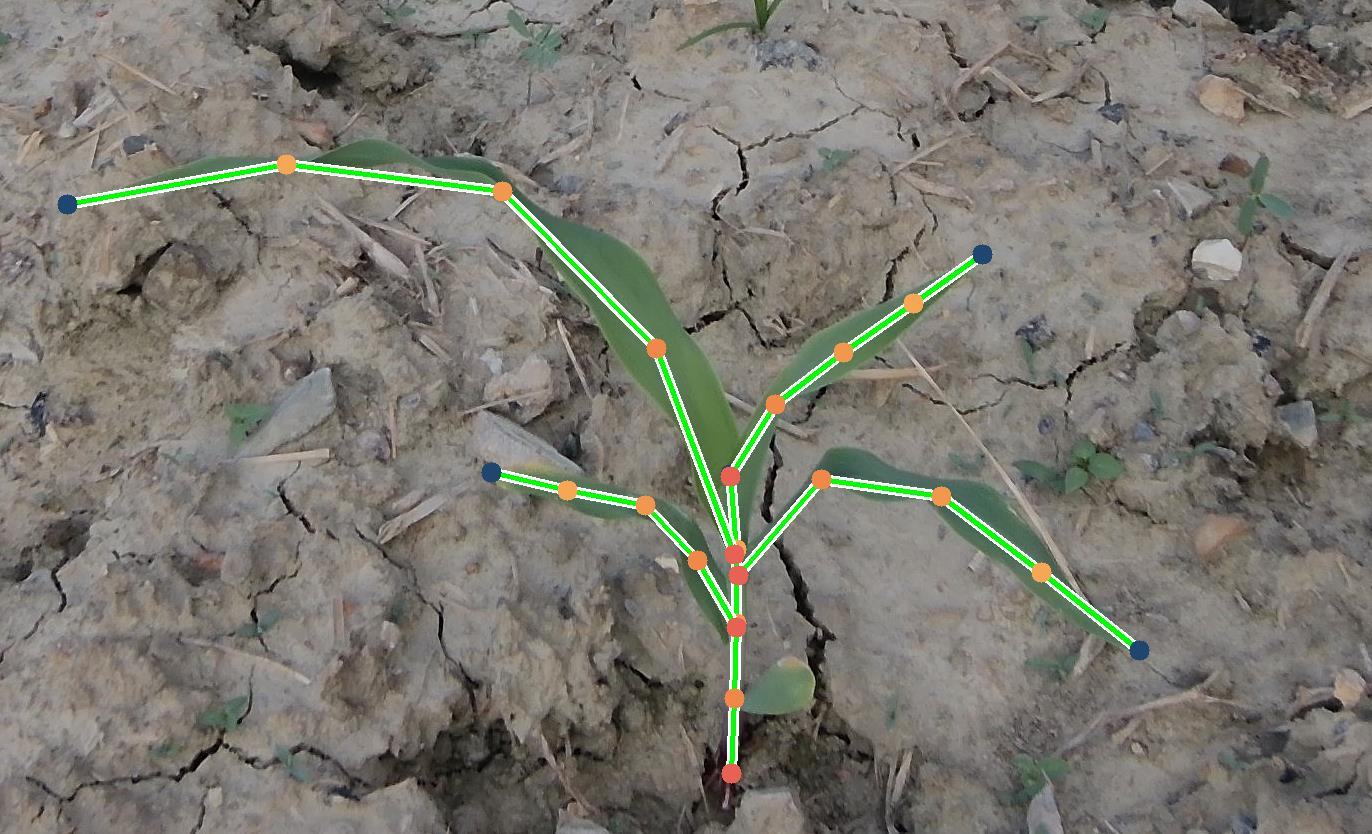

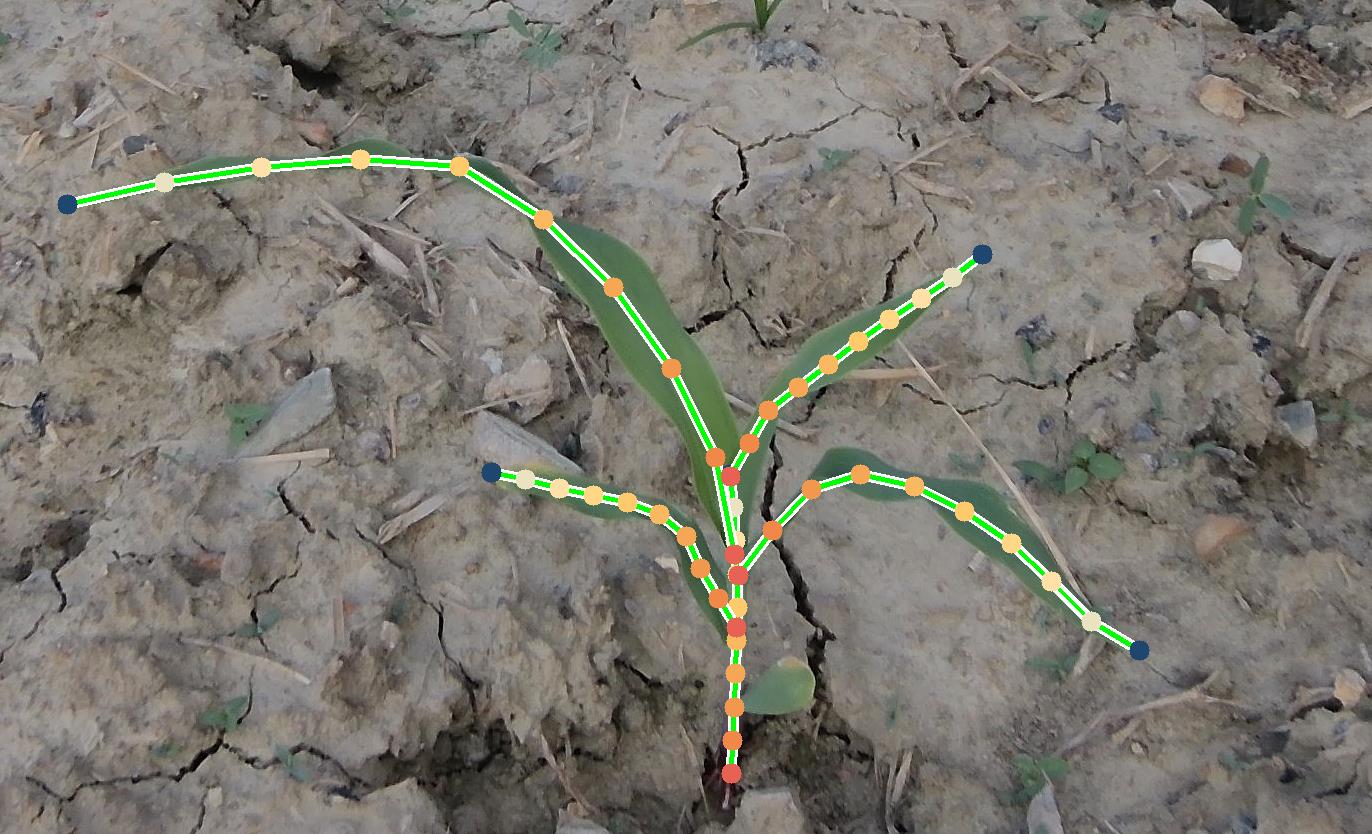

图3 不同采样策略的玉米植株关键点采样效果对比Fig. 3 Comparison of keypoint sampling results on maize plants using different sampling strategies |

| 原始数据 |  |  |  |

| 采样数:2 |  |  |  |

| 采样数:3 |  |  |  |

| 采样数:4 |  |  |  |

| 采样数:5 |  |  |  |

| 采样数:10 |  |  |  |

| 采样数:20 |  |  |  |

2.2 玉米植株骨架提取

2.2.1 基于改进YOLOv11-Pose模型的骨架提取性能

表1 不同模型的边界框检测性能对比Table 1 Comparison of bounding box detection performance of different models |

| 模型 | Precision | Recall | mAP50 | mAP50-95 |

|---|---|---|---|---|

| 改进YOLOv11-Pose | 0.717 | 0.495 | 0.579 | 0.372 |

| YOLOv11-Pose | 0.648 | 0.529 | 0.536 | 0.320 |

表2 不同模型的关键点检测性能对比Table 2 Comparison of keypoint detection performance of different models |

| 模型 | Precision | Recall | mAP50 | mAP50-95 |

|---|---|---|---|---|

| 改进YOLOv11-Pose | 0.641 | 0.442 | 0.490 | 0.349 |

| YOLOv11-Pose | 0.573 | 0.453 | 0.442 | 0.282 |

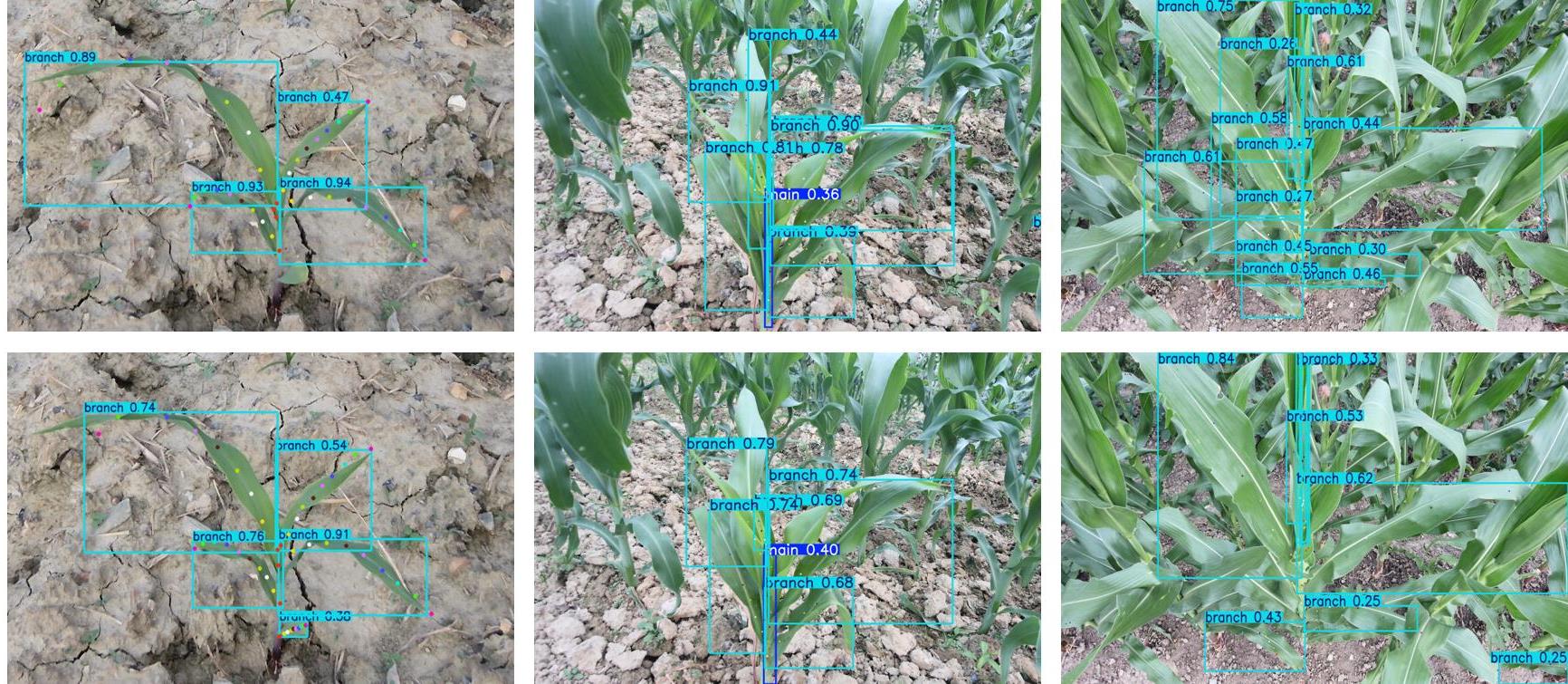

图5 玉米植株的边界框检测效果Fig. 5 Results of boundary box detection of maize plants |

| 改进模型 |  |

|---|---|

| 原始模型 |

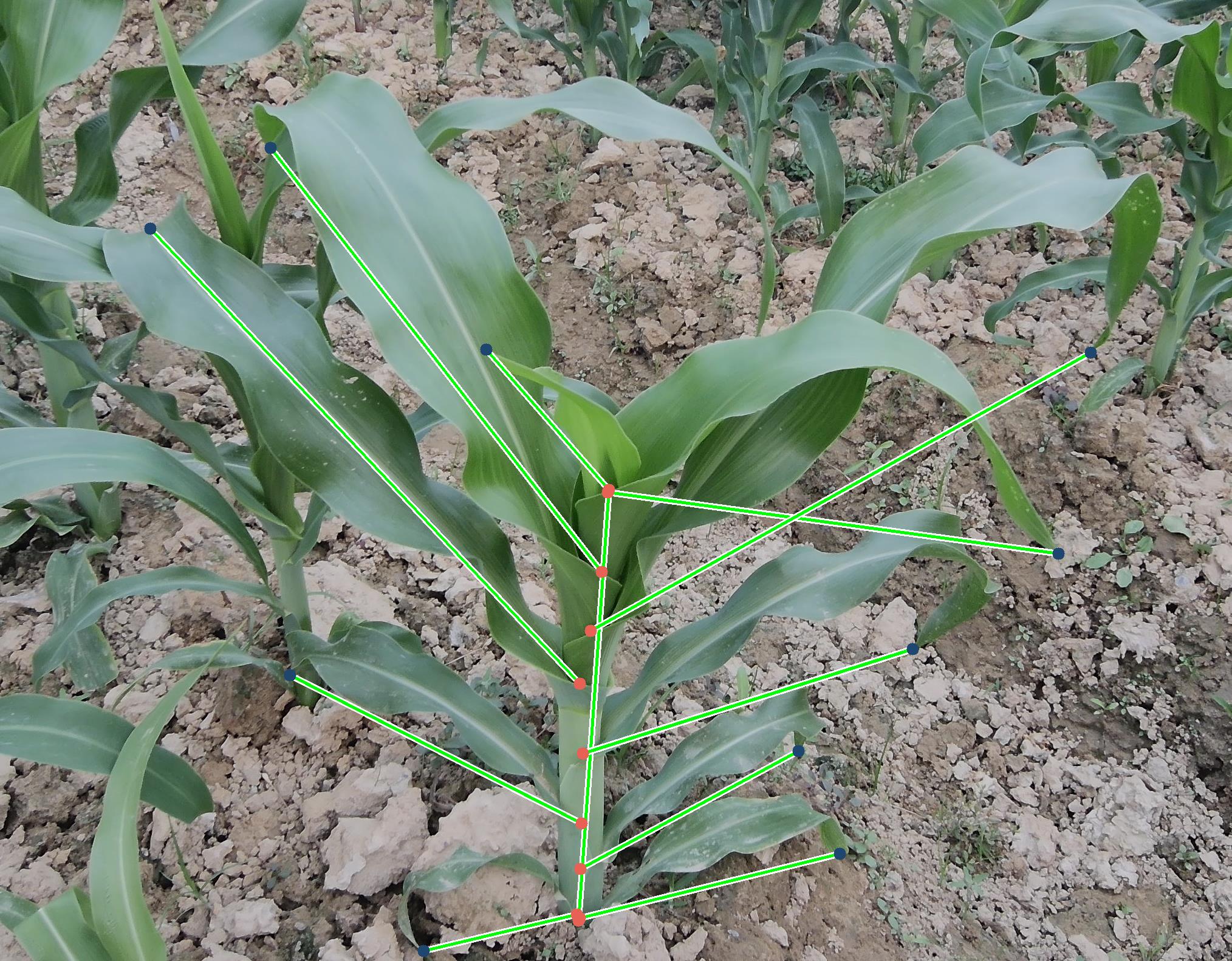

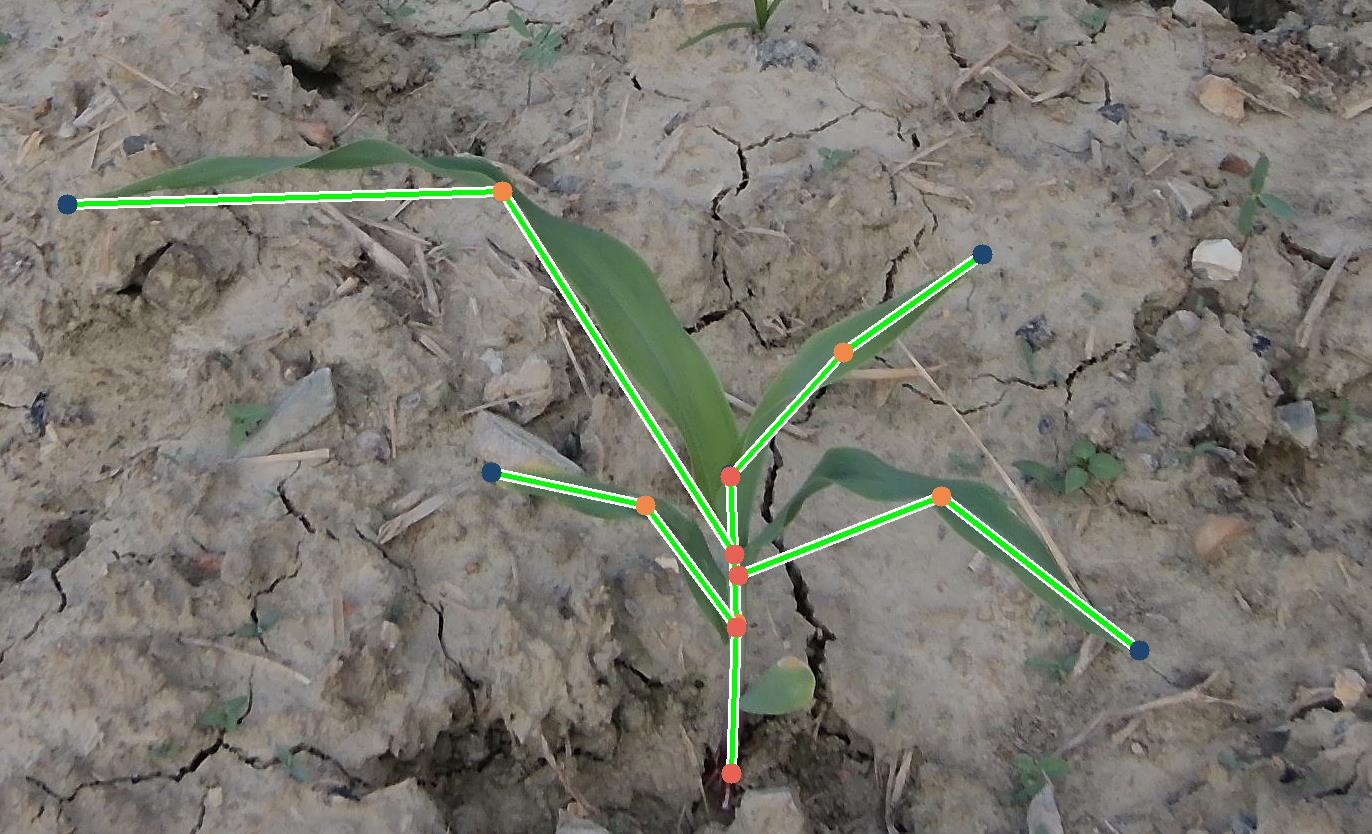

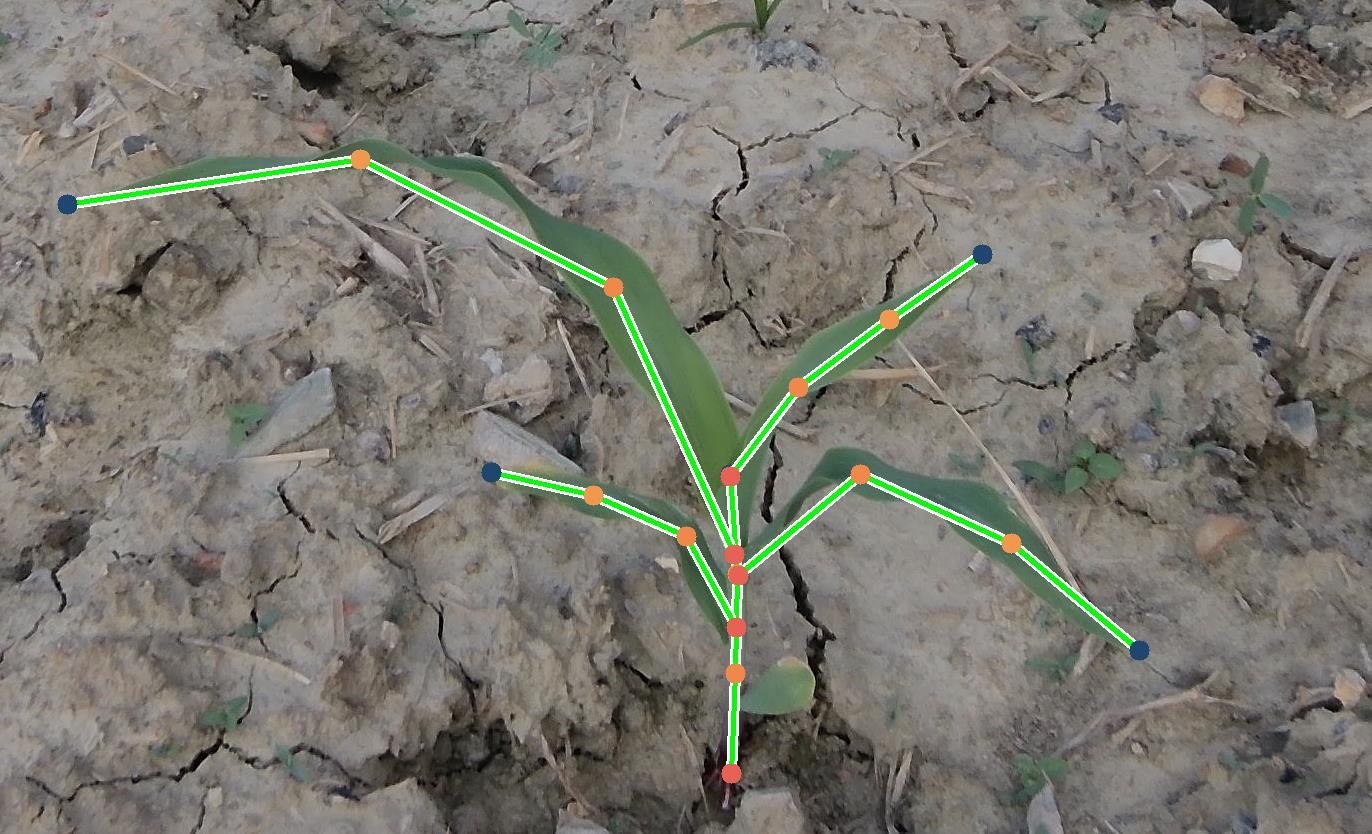

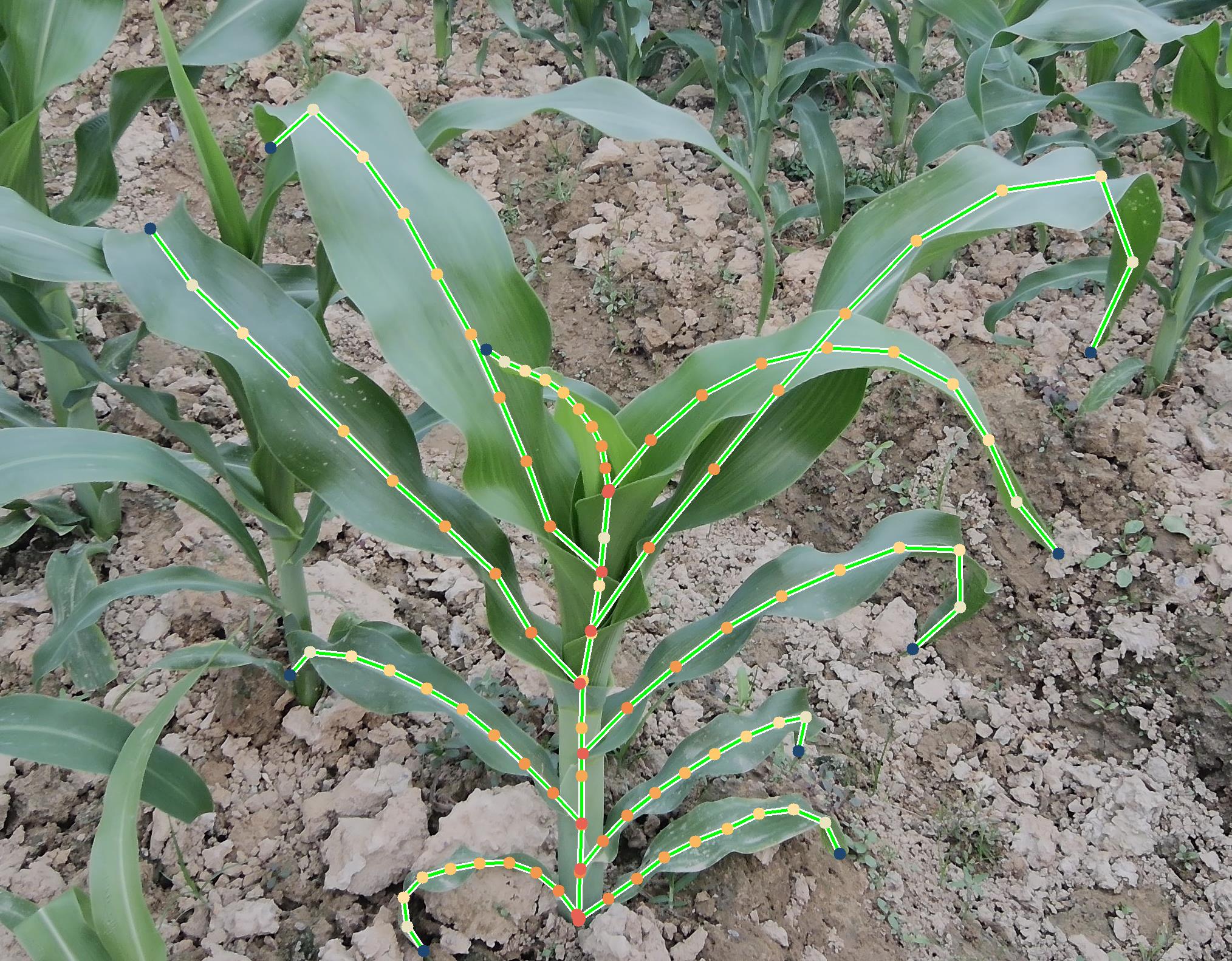

图6 玉米植株的关键点检测效果Fig. 6 Results of key point detection of maize plants |

| 改进模型 |  |

|---|---|

| 原始模型 |

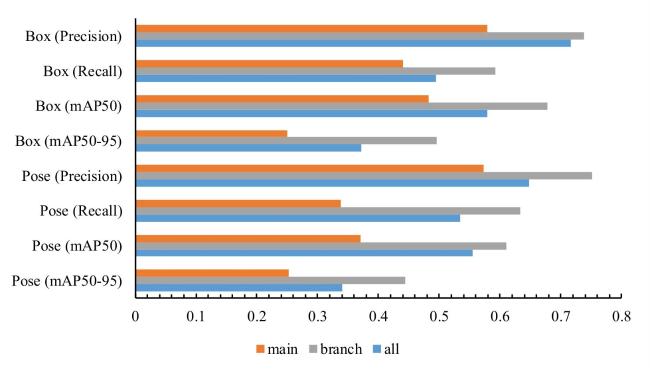

2.2.2 基于不同采样点数量的骨架提取性能

表3 不同采样策略的边界框检测性能对比(基于改进YOLOv11-pose模型)Table 3 Comparison of bounding box detection performance with different sampling strategies (based on the improved YOLOv11-pose model) |

| 采样数 | Precision | Recall | mAP50 | mAP50-95 |

|---|---|---|---|---|

| 2 | 0.761 | 0.605 | 0.656 | 0.398 |

| 3 | 0.606 | 0.515 | 0.527 | 0.290 |

| 4 | 0.684 | 0.598 | 0.622 | 0.360 |

| 5 | 0.674 | 0.527 | 0.581 | 0.328 |

| 10 | 0.717 | 0.495 | 0.579 | 0.372 |

| 20 | 0.661 | 0.520 | 0.562 | 0.338 |

表4 基于不同采样点数的关键点检测结果Table 4 Key point detection results based on different sampling points |

| 采样数 | Precision | Recall | mAP50 | mAP50-95 |

|---|---|---|---|---|

| 2 | 0.783 | 0.739 | 0.778 | 0.710 |

| 3 | 0.692 | 0.588 | 0.631 | 0.518 |

| 4 | 0.732 | 0.640 | 0.684 | 0.562 |

| 5 | 0.651 | 0.572 | 0.607 | 0.466 |

| 10 | 0.648 | 0.535 | 0.555 | 0.341 |

| 20 | 0.485 | 0.338 | 0.293 | 0.134 |

2.2.3 基于不同实例对象的骨架提取性能

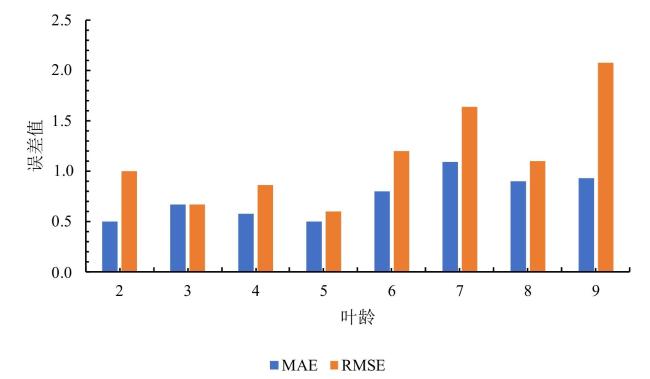

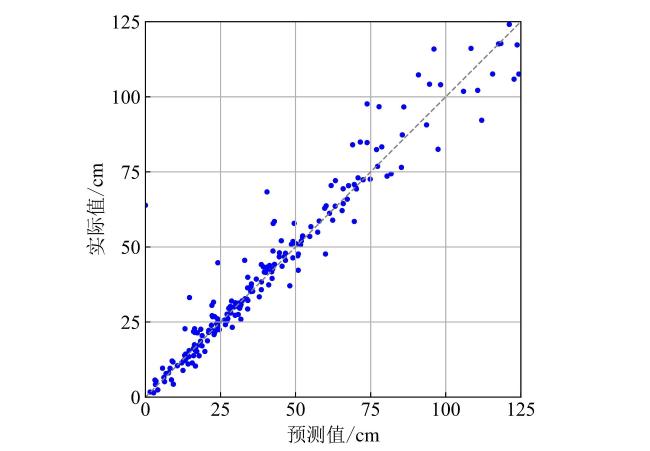

2.3 表型参数测量性能

表5 玉米株高测量结果Table 5 Measurement results of maize plant height |

| 长势数据 | MAE/cm | RMSE/cm | MAPE/% | R 2 |

|---|---|---|---|---|

| 株高(全部) | 2.435 | 13.621 | 6.561 | 0.949 |

| 株高(V2—V5) | 1.301 | 2.966 | 5.792 | 0.983 |

| 株高(V6—V9) | 3.796 | 26.406 | 7.484 | 0.931 |