语义分割作为计算机视觉领域的基础视觉任务,旨在建立图像到像素级类别标签的映射关系,最终生成具有明确语义边界的分割图

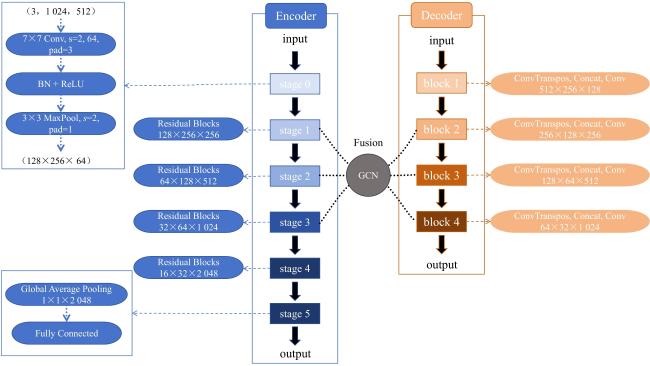

[9]。但是,在处理具有复杂结构和语义关系的图像时,传统语义分割方法面临罕见花卉分割效果欠佳、复杂场景精度待提升,以及上采样细节恢复空间信息不足等难题。图卷积是针对图结构数据设计的卷积运算方法,它能将图像的特征图视为图结构,把节点看作图像中的局部区域或特征,边代表节点间的关系

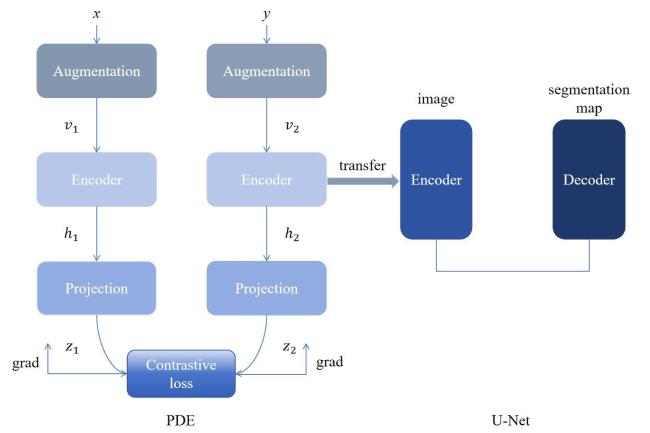

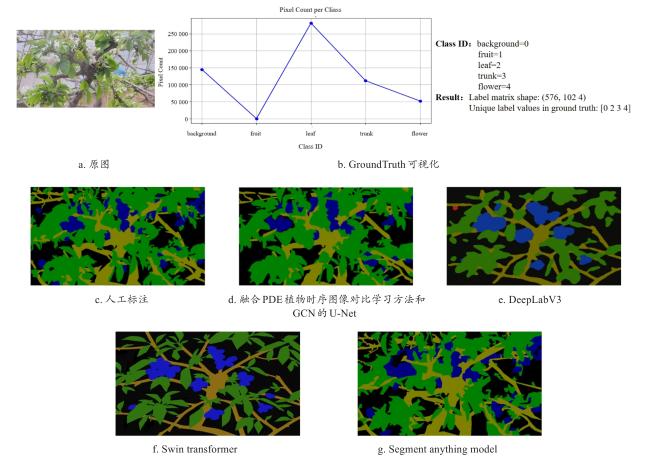

[10]。通过图卷积挖掘节点关系,能有效融合不同特征图的信息,恰好弥补语义分割在处理复杂关系时的不足。近年来,深度学习技术的革新促使基于卷积神经网络(Convolutional Neural Networks, CNN)

[11]的语义分割方法取得了突破性进展。从早期的全卷积网络(Fully Convolutional Networks, FCN)

[12]到后来的U-Net

[13]、SegNet

[14]等经典模型,通过不断改进网络结构和训练策略,语义分割的精度得到了显著提升。Paszke等

[15]提出新型深度神经网络架构ENet,为降低延迟任务设计,通过优化大幅减少FLOP、参数,提升速度,在多个数据集上进行对比测试,为移动端实时分割任务建立了新的效率基准。Siddique等

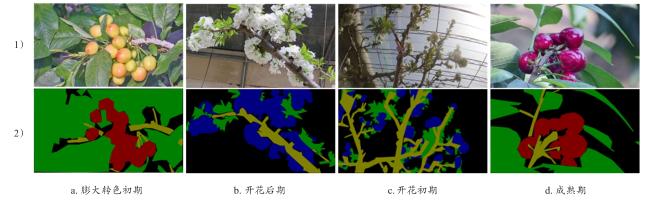

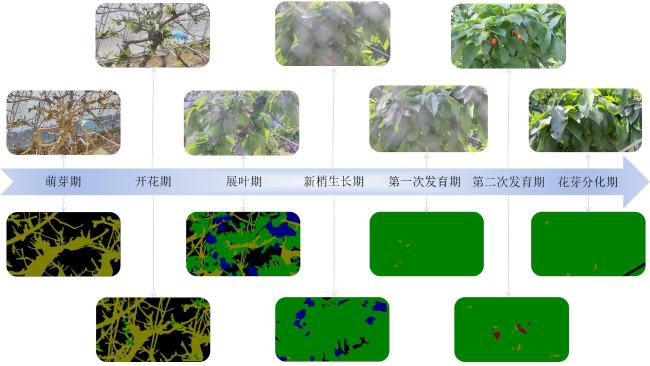

[16]提出自监督学习策略,用自动生成的伪标签提升模型对不同花卉的分割敏感度,采用数据增强和细化方法,将增强语义预测转为全景伪标签迭代训练多任务模型。Zhou等

[17]提出EAS-CNN(Evolvable Architecture Search CNN),利用进化算法自动设计CNN,优化网络结构和参数,以实现遥感图像语义分割。然而,当处理具有复杂背景的图像时,现有的语义分割仍面临一系列挑战。精准分割小目标边界,以及准确识别不同生长阶段的植株,提升对罕见花卉种类的分割性能、增强复杂场景下的分割精度,优化上采样过程中的细节以更高效地恢复空间信息等,亟须通过创新性方法实现突破。