0 引 言

1 材料与方法

1.1 图像数据采集与数据集构建

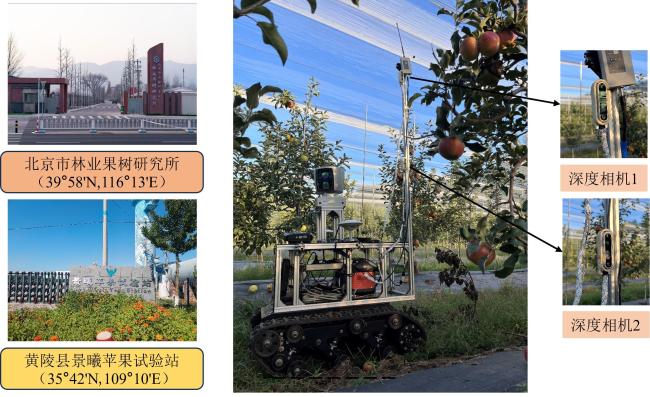

1.1.1 数据采集

1.1.2 数据增强

1.1.3 图像数据标注

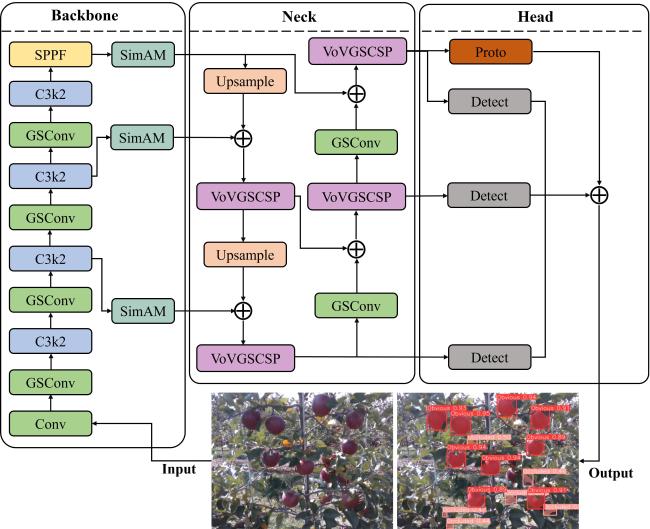

1.2 SSW-YOLOv11模型

1.2.1 Slim-Neck结构

1.2.2 SimAM自注意力机制模块

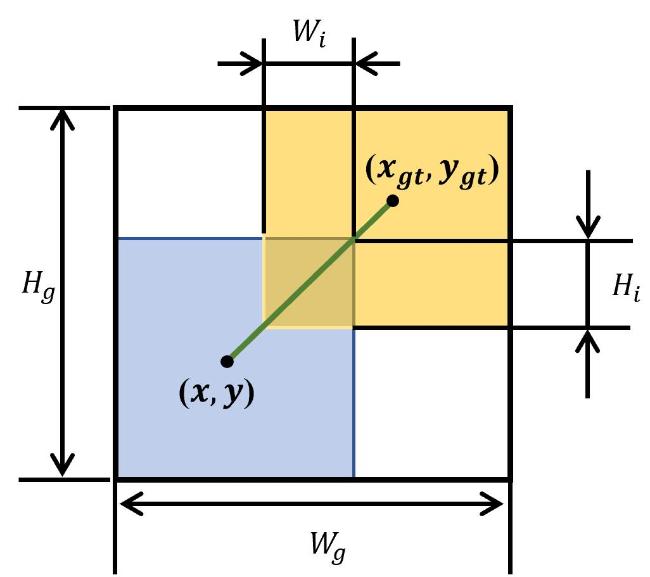

1.2.3 Wise-IoU损失函数

1.2.4 改进后的模型

2 结果与分析

2.1 模型训练参数

表1 SSW-YOLOv11n轻量化实例分割研究训练平台配置详情Table 1 Training platform configuration details of SSW-YOLOv11n lightweight instance segmentation research |

| 项目 | 配置 |

|---|---|

| 中央处理器 | Intel Xeon(R) Silver 4210 |

| 图形处理器 | NVIDIA GeForce RTX 2080 Ti/PCIe/SSE2 |

| 开发环境 | Python 3.8 |

| 深度学习框架 | CUDA10.2+CUDNN 8.2.0+Pytorch 1.12.0+Torchvision 0.13 |

| 操作系统 | Ubuntu 18.04 |

2.2 模型评价指标

2.3 消融实验

表2 SSW-YOLOv11n轻量化实例分割研究消融实验结果Table 2 SSW-YOLOv11n lightweight instance segmentation research ablation experiment results |

| 序号 | Slim-Neck | SimAM | Wise-IoU | Box mAP50/% | Mask P/% | Mask R/% | Mask mAP50/% | GFLOPS | 权重大小/MB | 帧率/FPS |

|---|---|---|---|---|---|---|---|---|---|---|

| 1 | × | × | × | 74.6 | 72.4 | 72.9 | 74.3 | 10.4 | 5.89 | 25.1 |

| 2 | √ | × | × | 75.1 | 72.5 | 73.4 | 75.1 | 10.0 | 5.72 | 26.5 |

| 3 | × | √ | × | 75.6 | 73.1 | 73.7 | 75.3 | 9.8 | 5.60 | 26.8 |

| 4 | × | × | √ | 74.7 | 71.3 | 71.2 | 74.8 | 10.1 | 5.64 | 25.5 |

| 5 | √ | √ | × | 76.1 | 72.7 | 72.3 | 76.2 | 9.3 | 5.28 | 28.4 |

| 6 | √ | × | √ | 75.5 | 72.2 | 72.5 | 75.5 | 9.7 | 5.05 | 27.9 |

| 7 | × | √ | √ | 75.7 | 72.8 | 72.6 | 75.6 | 9.5 | 4.85 | 27.6 |

| 8 | √ | √ | √ | 76.3 | 73.5 | 73.8 | 76.7 | 9.1 | 4.55 | 29.8 |

|

2.4 不同模型对比试验

表3 SSW-YOLOv11n轻量化实例分割研究不同模型对比试验结果Table 3 Comparative experiment results of different models of SSW-YOLOv11n lightweight instance segmentation research |

| 模型 | Box mAP50/% | Mask P/% | Mask R/% | Mask mAP50/% | GFLOPS | 权重大小/MB | 帧率/FPS |

|---|---|---|---|---|---|---|---|

| Mask R-CNN | 43.2 | 42.5 | 54.1 | 53.5 | 245.0 | 205.00 | 24.5 |

| SOLO | 47.2 | 57.2 | 55.3 | 56.4 | 132.0 | 176.00 | 24.6 |

| YOLACT | 44.8 | 57.9 | 42.4 | 55.3 | 79.6 | 143.00 | 24.8 |

| YOLOv11n | 74.6 | 72.4 | 72.9 | 74.3 | 10.4 | 5.89 | 25.1 |

| SSW-YOLOv11n | 76.3 | 73.5 | 73.8 | 76.7 | 9.1 | 4.55 | 29.8 |

2.5 边缘计算平台部署

表4 SSW-YOLOv11n在不同设备推理帧率对比Table 4 Comparison of inference frame rates for different devices of SSW-YOLOv11n |

| 模型 | 工作站/ FPS | NVIDIA Jetson TX2/ FPS |

|---|---|---|

| YOLOv11n | 72.5 | 25.1 |

| SSW-YOLOv11n | 88.9 | 29.8 |