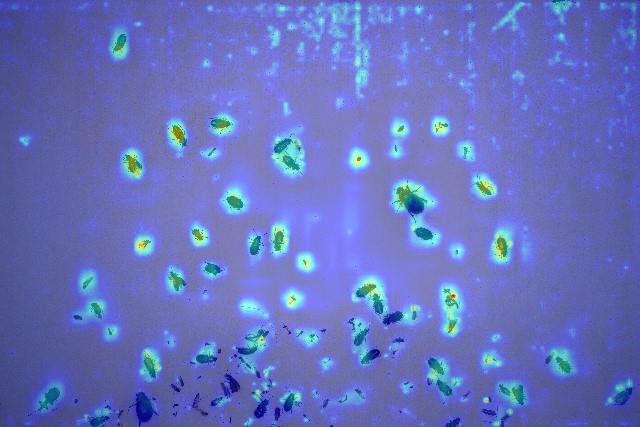

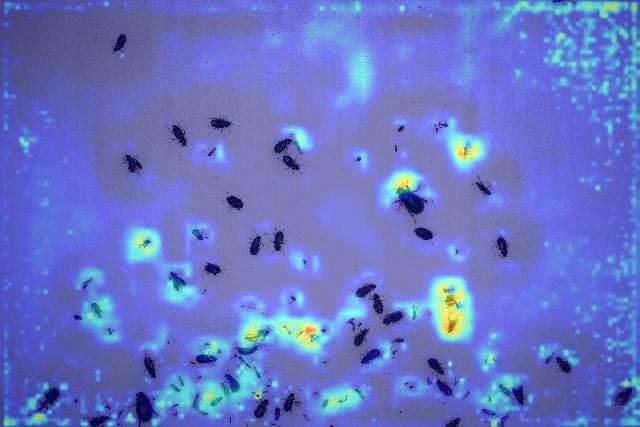

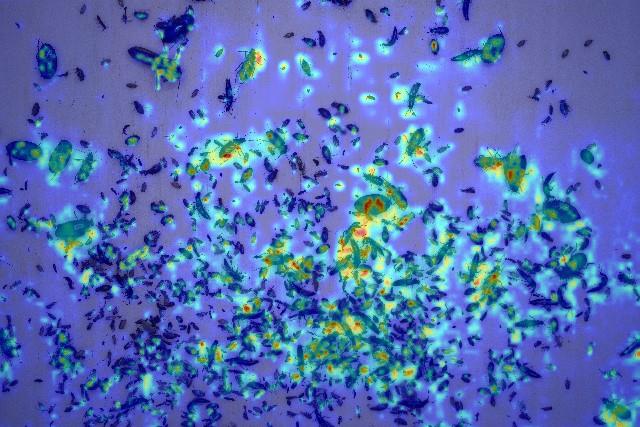

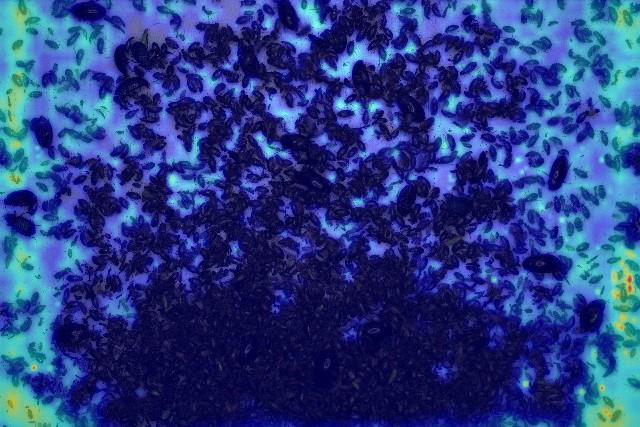

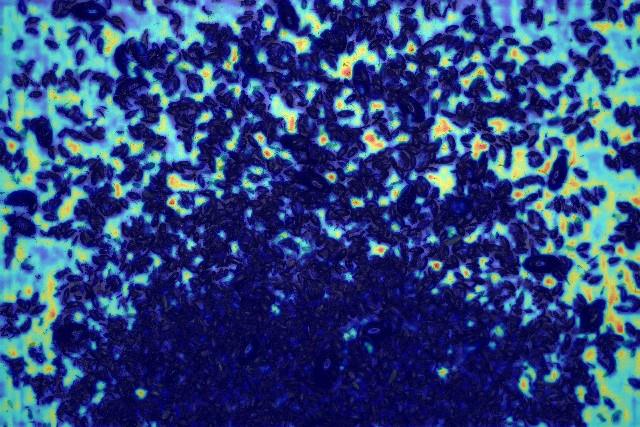

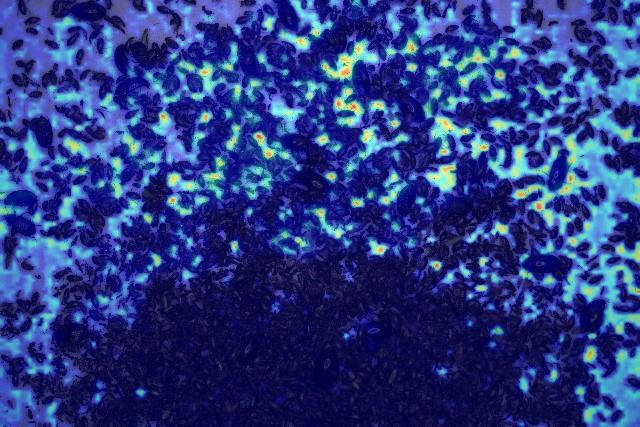

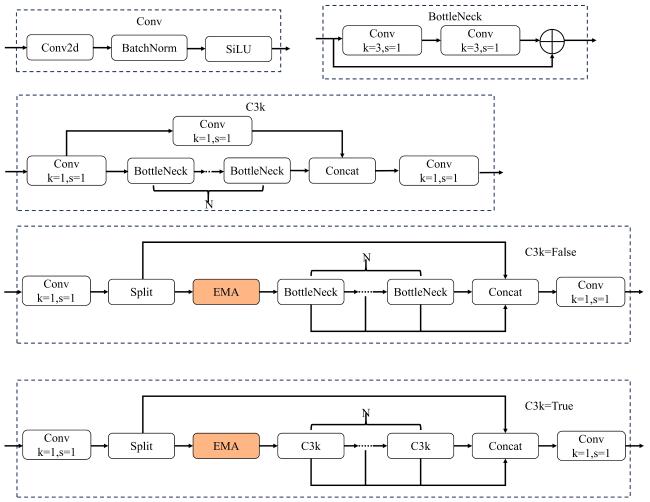

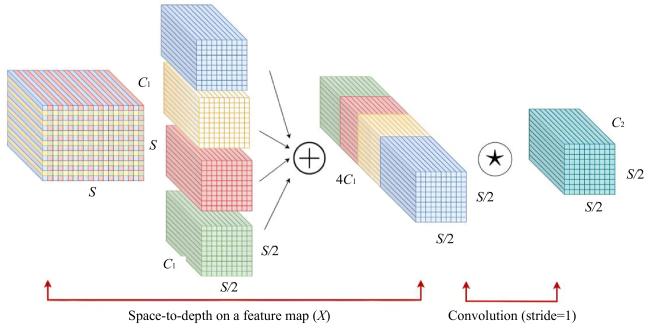

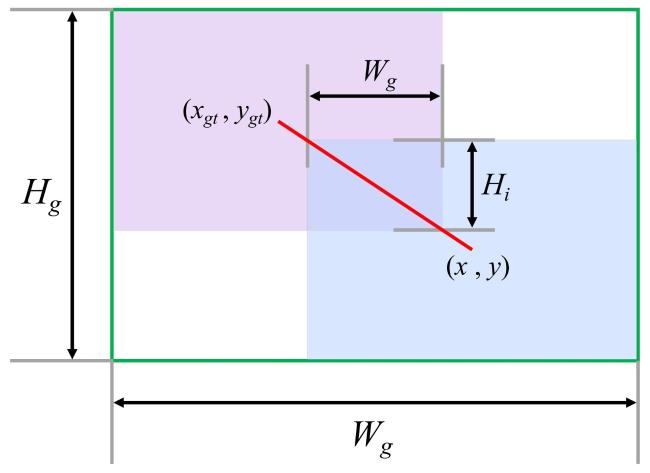

[Objective] Planthoppers suck the sap from the phloem of rice plants, causing malnutrition and slow growth of the plants, resulting in large-scale yield reduction. Therefore, timely and effective monitoring of planthopper pests and analysis of their occurrence degree are of vital importance for the prevention of rice diseases. The traditional detection of planthopper pests mainly relies on manual methods for diagnosis and identification. However, due to the tiny size of planthopper pests, on-site manual investigation is not only time-consuming and labor-intensive but also greatly influenced by human subjectivity, making it easy to misjudge. In response to the above issues, the intelligent light traps can be used to assist in the work. When using intelligent light traps to detect dense and occluded low-resolution and small-sized planthopper pests, problems such as low accuracy, false detection, and missed detection are prone to occur. For this purpose, based on YOLOv11x, a light-trapping rice planthopper detection method by combining spatial depth transform convolution and multi-scale attention mechanism was proposed in this research. [Methods] The image data in this research were collected by multiple light-induced pest monitoring devices installed in the experimental rice fields. The images included two types of planthopper pests, the brown planthopper and the white-backed planthopper. The image sizes were both 5 472 pixels ×3 648 pixels, totaling 998 images. The original dataset was divided into a training set and a validation set in a 4:1 ratio. To enhance the learning efficiency of the model during training, two data augmentation operations, horizontal flipping and vertical flipping, were performed on the images in the training set. A total of 2 388 images in the training set were obtained for model training, and 200 images in the validation set were used for model inference validation. To improve the model performance, first of all, the C3k2 module in the original YOLOv11x network was improved by using the efficient multi-scale attention (EMA) mechanism to enhance the perception of the model and the fusion ability of small-volume pest features in dense and occlusions. Secondly, the space-to-depth-convolution (SPD-Conv) was used to replace the Conv common convolution module in the original model, further improving the extraction accuracy of the model for low-resolution and small-volume pest features and reducing the number of parameters. In addition, a P2 detection layer was added to the original network and the P5 detection layer was removed, thereby enhancing the model's detection performance for small targets in a targeted manner. Finally, by introducing the dynamic non-monotonic focusing mechanism loss function wise-intersection over union (WIoU)v3, the positioning ability of the model was enhanced, thereby reducing the false detection rate and missed detection rate. [Results and Discussions] The test results showed that the precision (P), recall (R), mean average precision at IoU equals 0.50 (mAP50) and the mean average precision at IoU thresholded from 0.50 to 0.95 with a step size of 0.05 (mAP50-95) of the improved model on the self-built rice planthopper dataset (dataset_Planthopper) reached 77.5%, 73.5%, 80.8%, and 44.9% respectively. Compared with the baseline model YOLOv11x, it has increased by 4.8, 3.5, 5.5 and 4.7 percent points, respectively. The number of parameters has been reduced from 56 M to 40 M, a reduction of 29%. Compared with the current mainstream object detection models YOLOv5x, YOLOv8x, YOLOv10x, YOLOv11x, YOLOv12x, Salience DETR-R50, Relation DETR-R50, RT-DETR-x, the mAP50 of the improved model was 6.8, 7.8, 8.6, 5.5, 5.6, 8.7, 6.9 and 6.9 percentage points higher, respectively, and it had the best comprehensive performance. [Conclusions] The improved YOLOv11x model effectively enhances the performance of detecting low-resolution and small-sized planthopper pests under dense and occluded insect conditions, and reduces the probability of missed detection and false detection. In practical applications, it could assist in achieving precise monitoring of farmland pests and scientific prevention and control decisions, thereby reducing the use of chemical pesticides and promoting the intelligent development of agriculture. Although this method has achieved significant improvements in multiple indicators, it still had certain limitations. Firstly, the species of planthoppers were numerous and their forms were diverse. The current models mainly targeted some typical species, and their generalization ability needed to be further verified. Secondly, due to the limitations of the data collection environment, there was still room for improvement in the performance of the model under extreme lighting changes and extremely occluded scenarios. Finally, although the number of parameters had decreased, the real-time detection speed still needed to be optimized to meet the requirements of some low-power edge devices. Future research can focus on expanding the generalization, robustness and lightweighting of more types of rice planthopper models in more complex situations.