0 引 言

1 研究方法

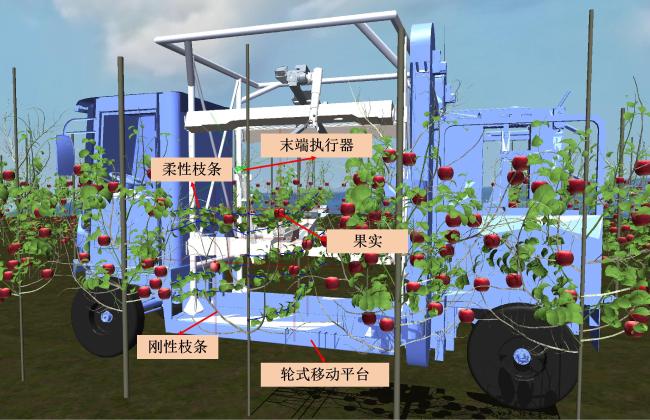

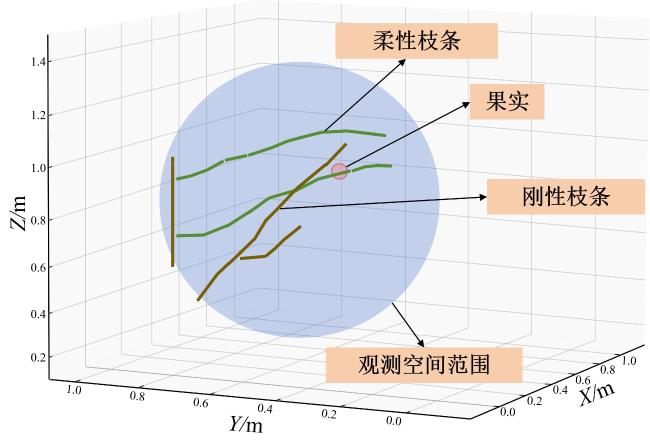

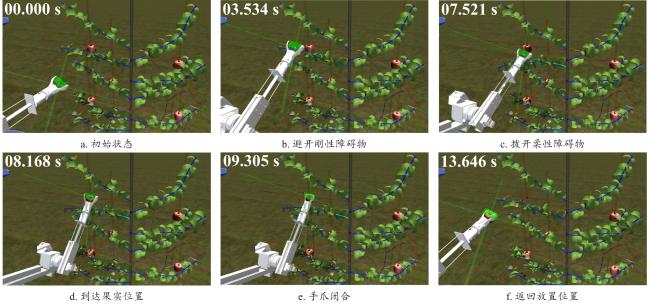

1.1 MuJoCo仿真环境构建与刚柔障碍物建模

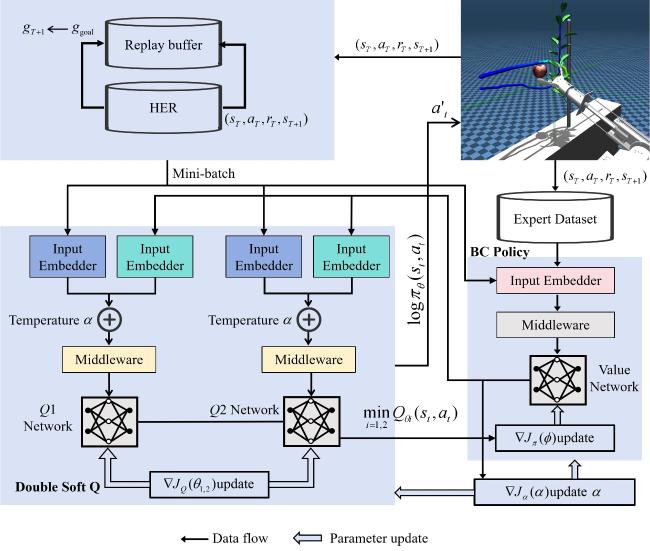

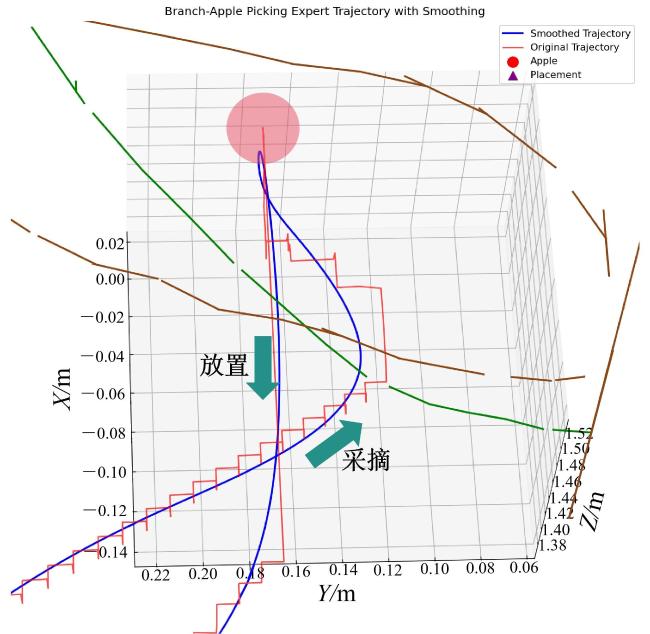

1.2 专家经验引导的SAC深度强化学习算法

2 结果与分析

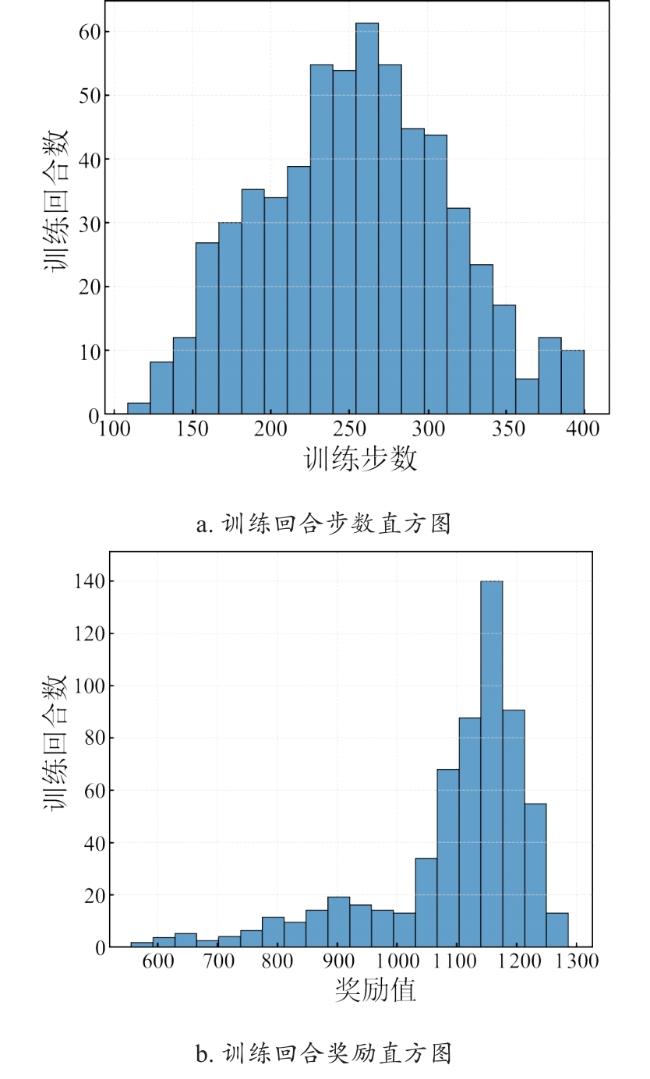

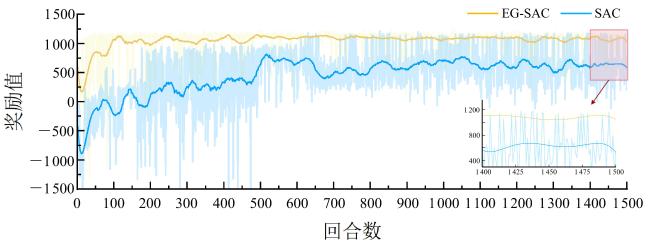

2.1 仿真试验

表1 SAC/EG-SAC算法统一超参数设置Table 1 Unified hyperparameter settings for SAC/EG-SAC algorithms |

| Parameter | Value |

|---|---|

| Actionsize | 8 |

| Observationsize | 425 |

| Networksize | 512 512 |

| Batchsize | 1 024 |

| Buffersize | 106 |

| Learningrate | 0.001 |

| Trainingsteps | 600 |

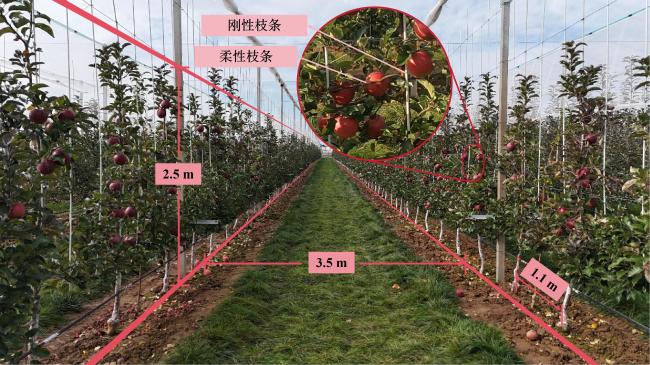

2.2 果园现场试验

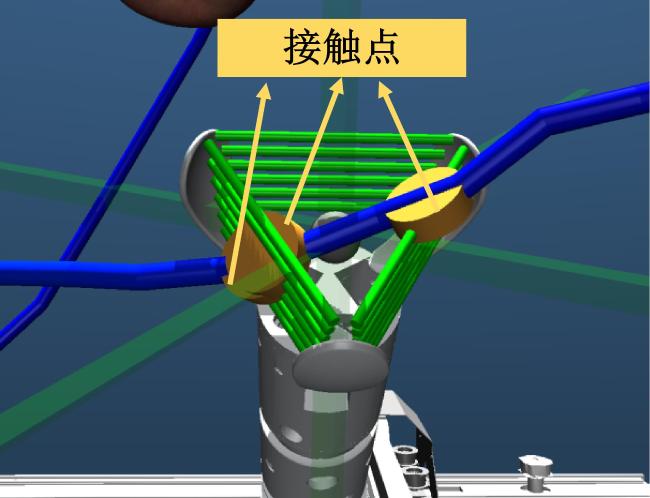

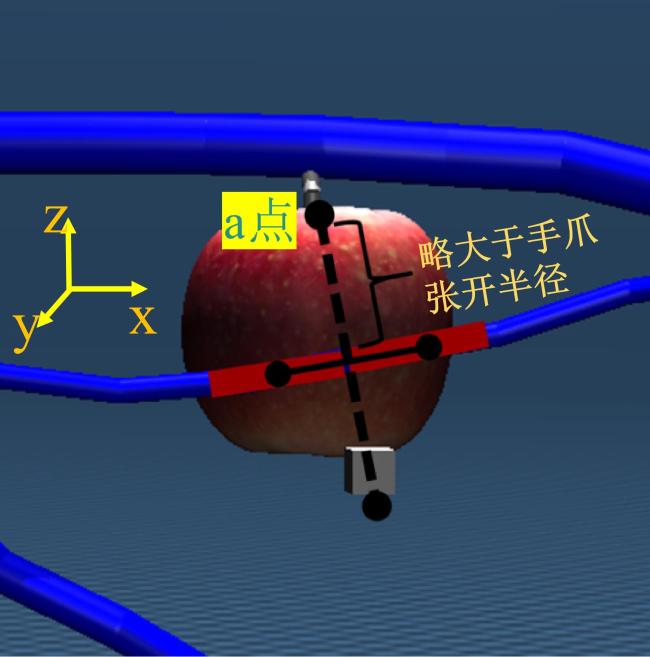

2.2.1 苹果采摘执行系统

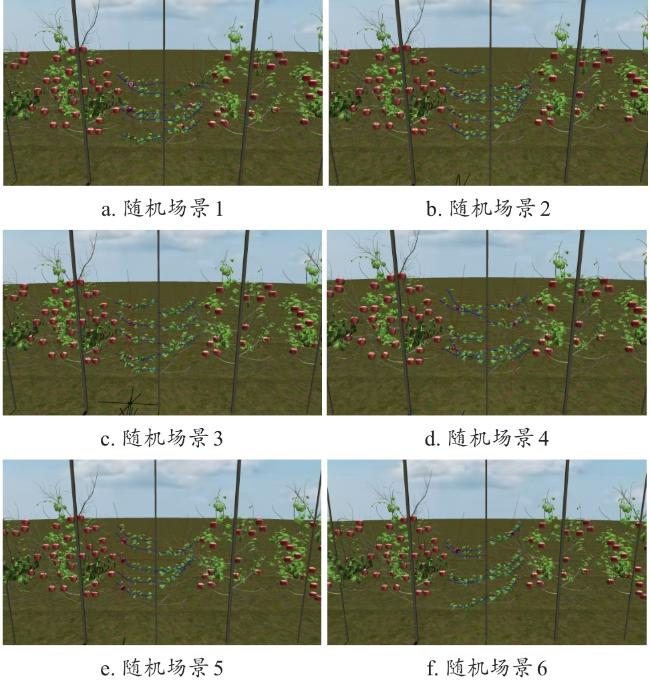

2.2.2 现场试验场景设计

2.2.3 采摘规划控制策略

2.2.4 试验结果与分析

表2 EG-SAC方法与RRT方法性能对比Table 2 Performance comparison between the EG-SAC method and the RRT method |

| 模型 | 场景 | 抓果 次数/次 | 成功 数/次 | 抓空 数/次 | 抓到障碍物数/次 | 抓住后掉落数/次 | 对准抓失败数/次 | 与刚性碰撞数/次 | 放弃抓果数/次 | 平均 耗时/s |

|---|---|---|---|---|---|---|---|---|---|---|

| EG-SAC | 场景一 | 20 | 16 | 1 | 3 | 2 | 1 | 0 | 0 | 12.11 |

| 场景二 | 20 | 12 | 1 | 4 | 2 | 2 | 0 | 3 | 12.24 | |

| 场景三 | 20 | 15 | 0 | 1 | 1 | 0 | 1 | 4 | 12.62 | |

| RRT | 场景一 | 20 | 7 | 1 | 17 | 2 | 6 | 0 | 4 | 11.23 |

| 场景二 | 20 | 6 | 1 | 11 | 2 | 2 | 3 | 9 | 12.18 | |

| 场景三 | 20 | 8 | 2 | 6 | 4 | 1 | 13 | 5 | 11.64 |

表3 EG-SAC/RRT方法各场景成功率与碰撞率统计对比Table 3 Statistical comparison of success rates and collision rates of EG-SAC/RRT methods in various scenarios |

| 方法 | 指标类型 | 场景一 | 场景二 | 场景三 | 平均值 |

|---|---|---|---|---|---|

| EG-SAC | 成功率/% | 80 | 60 | 75 | 71.7 |

| 碰撞率/% | 10 | 20 | 10 | 13.3 | |

| RRT | 成功率/% | 35 | 30 | 40 | 35.0 |

| 碰撞率/% | 85 | 70 | 90 | 81.7 |

表4 EG-SAC/RRT方法失效模式统计分析Table 4 Statistical analysis of failure modes for EG-SAC/RRT methods |

| 失效类型 | EG-SAC出现次数/次 | RRT出现次数/次 | 主要原因分析 |

|---|---|---|---|

| 抓空 | 2 | 4 | 果实定位误差/手爪精度不足 |

| 抓到障碍物 | 8 | 34 | 路径规划不当/拨枝时摩擦力不足拨枝失败 |

| 抓住后掉落 | 5 | 8 | 夹持力控制问题/被障碍物阻挡 |

| 对准抓失败 | 3 | 9 | 连同枝条一起抓到导致抓取失败 |

| 刚性碰撞 | 1 | 16 | 避障策略失效 |

| 放弃抓果 | 7 | 18 | 安全策略触发 |