近年来,深度学习图像检测技术在农业领域得到广泛的应用,涵盖成熟度检测、病虫害监测、障碍物检测、采收点定位、农作物分级等多个方面

[4]。张润池等

[5]提出的基于改进YOLOv8n网络的番茄成熟度检测算法在YOLOv8网络中引入通道嵌入位置注意力模块和改进大核卷积块注意力模块,实现了模型的轻量化部署,但该算法在复杂光照条件下的识别精度仍有提升空间。袁杰等

[6]提出一种改进的YOLOv7的苹果叶片病害检测方法,通过特征金字塔替代原有融合方式、采用通道注意力机制及SIoU(Structured Intersection over Union)损失函数,有效提升了模型性能,但单幅图像处理时间尚未达到最优水平。杨昊霖等

[7]提出一种基于改进YOLOv5的田间复杂环境障碍物检测方法,通过K-means聚类优化先验锚框、引入卷积块注意力机制(Convolutional Block Attention Module, CBAM)及Ghost卷积,在提升精度的同时降低了参数量,但准确率仍具改进空间。李扬等

[8]采用改进单次多框检测器(Single Shot Multibox Detector, SSD)算法实现了对苹果的精准定位与分级,该方法用分离卷积模块替换了原SSD网络主干特征提取网络中部分标准卷积,实现了对苹果果径和果形分级的精确率达到94.89%,但该方法在减少功耗与用时的同时精度有所降低。Zhao等

[9]提出一种YOLOv8x-SPPCSPC-CBAM模型实现对新鲜茶叶品质的精准分级,该模型集成空间金字塔池化跨阶段部分连接(Spatial Pyramid Pooling with Channel Spatial Pooling, SPPCSPC)模块并引入CBAM注意力机制,实现散落和堆叠的茶叶的检测准确率分别为98.2%和99.1%。Fan等

[10]提出了一种基于YOLOv5的轻量级模型,用于在清洁或复杂场景中检测和识别粗细品种水果并在线分级,结合C3Ghostv2模块和Wise IoU损失函数,在复杂场景中实现了93.6%的mAP,但仍存在漏检现象。汪小旵等

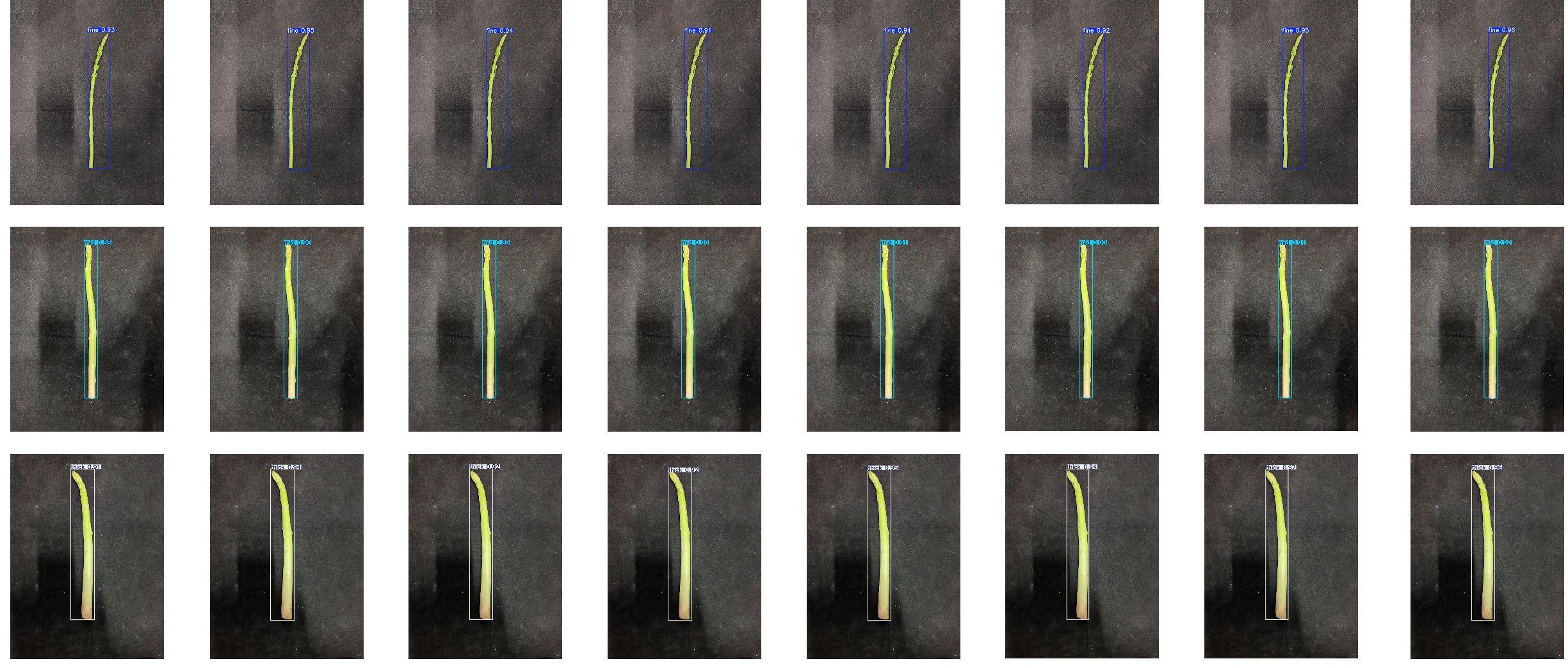

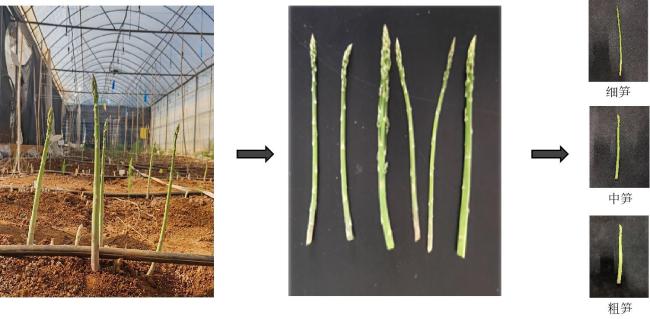

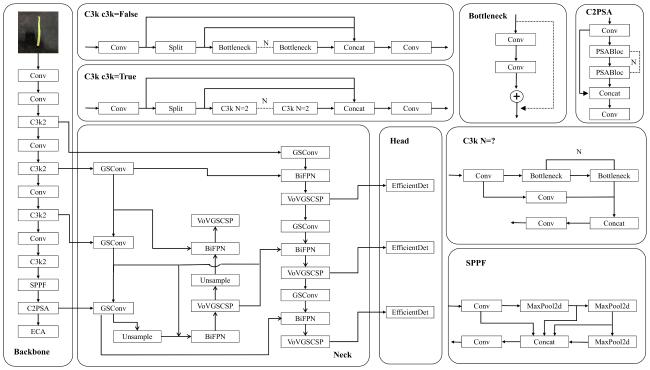

[11]提出一种改进的YOLACT(You Only Look At Coefficients)++算法获取芦笋的掩膜,经过骨架拟合之后评估芦笋的长度和基部直径,分级之后进行采收,该方法通过添加CBAM注意力机制和空间金字塔池化(Spatial Pyramid Pooling, SPP)结构使得改进后的YOLACT++算法芦笋判别准确率达到95.24%,并且在检测时间上相较于其他算法优势显著。