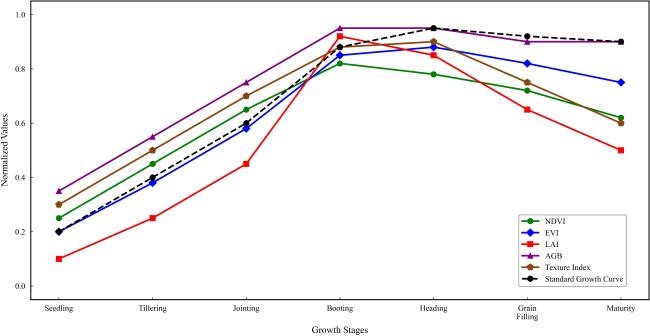

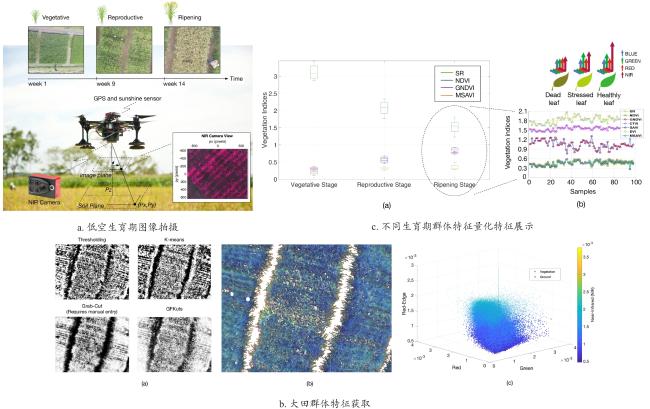

群体指标往往在水稻全生育时期中的部分阶段,如拔节期、孕穗期、抽穗期和灌浆期(Filling Stage),表现出显著的光谱特征和生理特征,植被指数(Vegetation Index, VI)、TI、LAI和AGB等量化指标能够准确捕捉到这些时期冠层的变化。其中,分蘖期是稻株快速生长、冠层快速增大的时期,此时叶片迅速增加,Wu等

[ 39]在多个生长阶段的水稻LAI估算性能研究中证明了LAI在前中期具有较高的识别能力。此外,分蘖期叶面积和叶绿素含量快速增加,植株的光合能力加强,光谱反射率变化显著,VI如NDVI能够有效捕捉植被吸收红光和反射近红外光的变化,展示出较高的识别效果。如Rosle等

[ 40]利用NDVI进行早期生长阶段监测,能快速、直观地评估稻田的生长状况,尤其适用于大面积农田的快速监测。拔节期是水稻生长的关键阶段,植株高度迅速增加,生长速率明显加快,由于植株的光合能力增强,光谱特征变化显著,多类指标均能较好地反映这一时期的生长状态。AGB指数在此阶段表现突出,对地上生物量的累积具有良好的监测效果,尤其在高生产力的水稻品种中,拔节期AGB积累迅速

[ 35]。随着水稻冠层逐渐覆盖土壤,修正型土壤调节植被指数(Modified Soil-Adjusted Vegetation Index, MSAVI)与实际的水稻生长速率高度相关,尤其在高冠层覆盖情况下,MSAVI表现出更高的精度

[ 37]。牛亚晓等

[ 38]利用无人机搭载多光谱传感器,发现MSAVI对植株生长冠层覆盖度的捕捉效果显著,可以实现精准的冠层覆盖度监测。然而,在大规模种植田中使用MSAVI时,尽管能够减少土壤背景干扰,提升对植株生长的识别精度,但对于复杂田间冠层结构,可能受叶片遮蔽影响,亦有识别精度下降的风险,具体应用时需注意区分。孕穗期是水稻生长的关键转折点,植株开始为抽穗做准备,冠层结构变得复杂,穗头逐渐形成,叶片达到最大覆盖度

[ 41]。在这个阶段,LAI达到最大值,其反馈的水稻冠层密度和生长状态亦可作为这个阶段识别的关键特征

[ 42]。Xue等

[ 6]通过长时间序列的VI变化,验证了这类指数能够很好地捕捉冠层的复杂变化,在孕穗期监测中具有很高的应用潜力。与此同时,TI对冠层异质性和结构变化极为敏感,同时期VI值达到高峰,两者的融合为探索生育期的精准估测提供了新的途径。利用无人机遥感监测技术结合VI和TI,评估孕穗期水稻冠层的复杂结构变化,可有效识别稻穗的形成和排列

[ 43]。尽管VI和TI能够为冠层密集且结构复杂的水稻提供高精度监测,但受品种类型的干扰,过于复杂的冠层结构和穗与叶的遮蔽效应仍会影响识别准确性。灌浆期是水稻生长的重要阶段,群体指标达到峰值后,逐渐下降,反映出冠层的叶绿素含量和光合作用效率的降低

[ 29]。一方面,这一时期EVI的监测表现出色,能够细致捕捉到水稻灌浆过程中冠层光合作用的减少,其时序特征可作为灌浆期识别的关键指标。此外,灌浆期还表现出AGB继续积累和叶绿素含量下降的共表达趋势。因此,通过VI指数结合AGB也能够很好地反映出该阶段与其他生育期的差异性特征。另一方面,研究显示,EVI在灌浆期对冠层光合变化的监测表现最佳,能够细致捕捉冠层光合作用的细微变化

[ 27],利用EVI反馈的灌浆期细微光谱变化,可一定程度地反馈水稻的衰老进程,为量化不同灌浆阶段提供了可能。成熟期(Maturity stage)是水稻完全成熟、籽粒硬化的阶段,叶片光合作用逐渐减弱,冠层光谱反射参数加速下降或下降后保持停滞,反映出冠层的光合部位逐渐衰退和叶绿素的竭耗。该时期光合能力显著下降,利用光谱反射率能很好地识别到这一时期的特征变化

[ 44]。而AGB在成熟期达到最大值,增产趋势逐渐放缓。这些均可作为成熟期的识别特征用于生育期识别与监测

[ 30]。