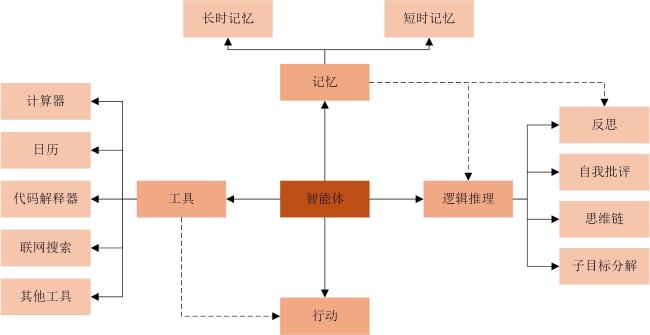

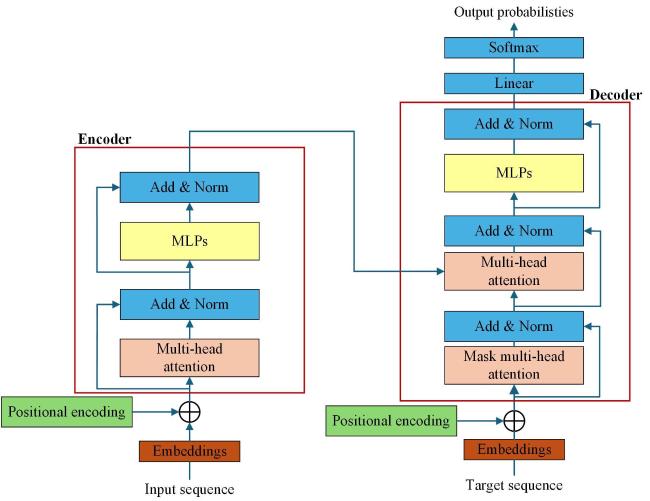

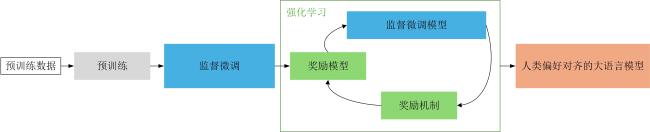

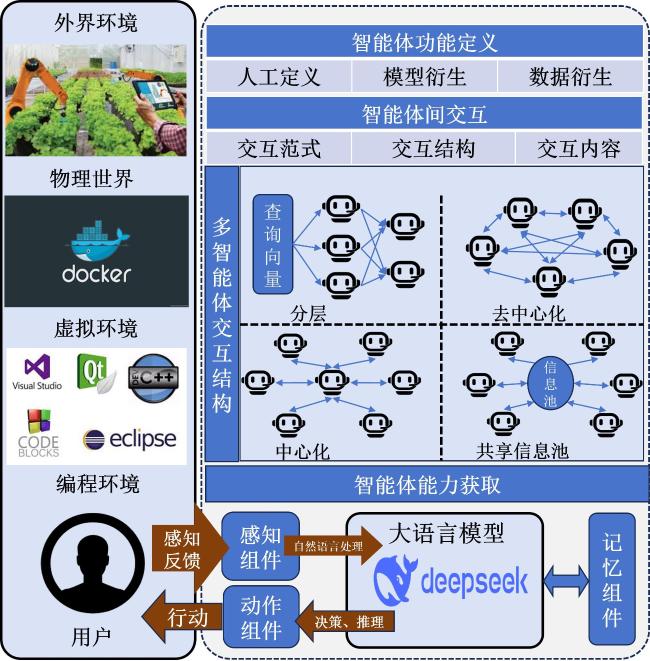

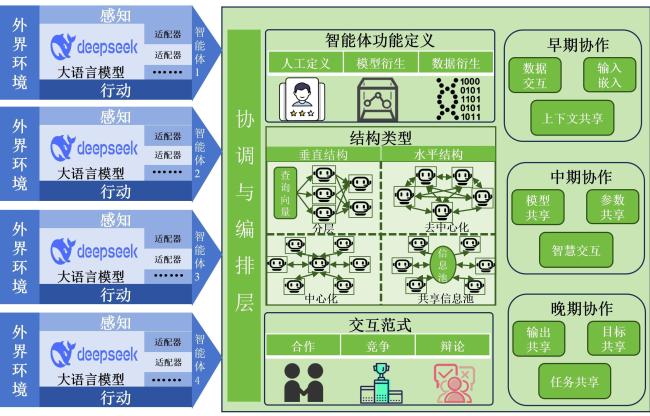

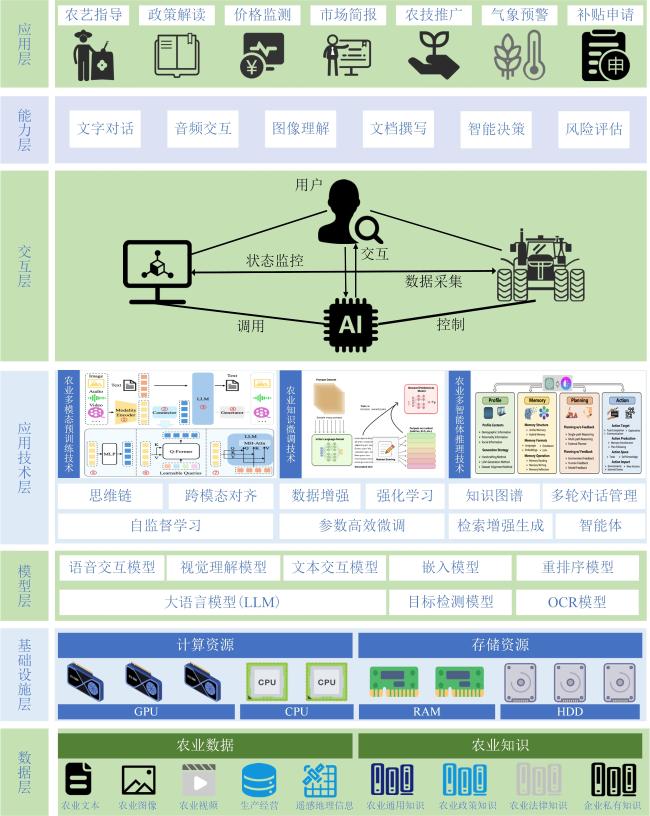

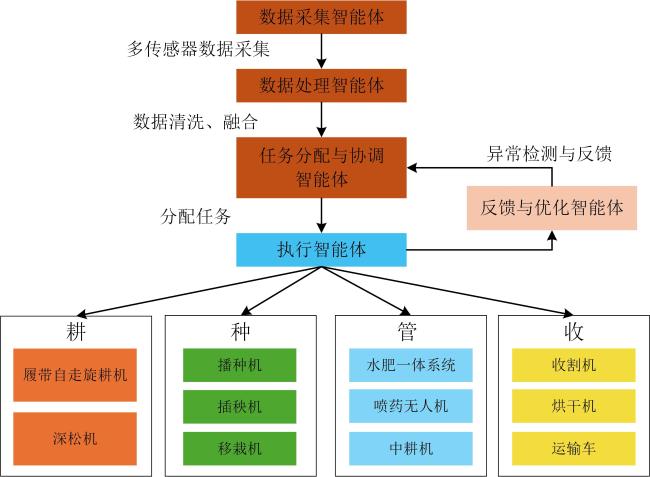

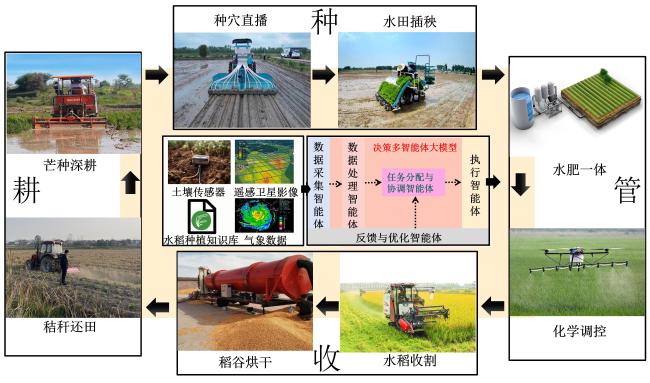

[Significance] With the rapid advancement of large language models (LLM) and multi-agent systems, their integration, multi-agent large language models, is emerging as a transformative force in modern agriculture. Agricultural production involves complex, sequential, and highly environment-dependent processes, including tillage, planting, management, and harvesting. Traditional intelligent systems often struggle with the diversity, uncertainty, and coordination of these stages' demand. Multi-agent LLMs offer a new paradigm for agricultural intelligence by combining deep semantic understanding with distributed collaboration and adaptive coordination. Through role specialization, real-time perception, and cooperative decision-making, they can decompose complex workflows, adapt to changing conditions, and enable robust, full-process automation, making them well-suited to the challenges of modern agriculture. More importantly, their application marks a critical step toward the digital transformation, precision management, and sustainable development of agriculture. By enabling intelligent decision-making across the entire agricultural lifecycle, they provide both theoretical foundations and practical tools for building next-generation smart and unmanned farming systems. [Progress] The core concepts of multi-agent LLMs are first elucidated, covering the composition and characteristics of multi-agent systems as well as the development and training pipelines of LLMs. Then, the overall architecture of multi-agent systems is presented, encompassing both the environments in which agents operate and their internal structures. The collaborative patterns of multi-agent LLMs are then examined in terms of coordination structures and temporal organization. Following this, interaction mechanisms are discussed from multiple dimensions, including interactions between agents and the external environment, inter-agent communication, communication protocol frameworks, and communication security. To demonstrate the varying task specializations of different multi-agent frameworks, a comparative benchmark survey table is provided by synthesizing benchmark tasks and results reported in existing studies. The results show that different multi-agent large language model architectures tend to perform better on specific types of tasks, reflecting the influence of agent framework design characteristics such as role assignment strategies, communication protocols, and decision-making mechanisms. Furthermore, several representative architectures of multi-agent LLMs, as proposed in existing studies, are briefly reviewed. Based on their design features, their potential applicability to agricultural scenarios is discussed. Finally, current research progress and practical applications of LLMs, multimodal large models, and multi-agent LLMs in the agricultural domain are surveyed. The application architecture of agricultural LLMs is summarized, using rice cultivation as a representative scenario to illustrate the collaborative process of a multi-agent system powered by LLMs. This process involves data acquisition agents, data processing agents, task allocation and coordination agents, task execution agents, and feedback and optimization agents. The roles and functions of each kind of agent in enabling automated and intelligent operations throughout the entire agricultural lifecycle, including tillage, planting, management, and harvesting, are comprehensively described. In addition, drawing on existing research on multimodal data processing, the pseudocode is provided to illustrate the basic logic of the data processing agents. [Conclusions and Prospects] Multi-agent LLMs technology holds vast promise in agriculture but still confronts several challenges. First, limited model interpretability, stemming from opaque internal reasoning and high-dimensional parameter mappings, hinders decision transparency, traceability, user trust, and debugging efficiency. Second, model hallucination is significant, probabilistic generation may deviate from facts, leading to erroneous environmental perception and decisions that cause resource waste or crop damage. Third, multi-modal agricultural data acquisition and processing remain complex due to non-uniform equipment standards, heterogeneous data, and insufficient cross-modal reasoning, complicating data fusion and decision-making. Future directions include: (1) enhancing interpretability via chain-of-thought techniques to improve reasoning transparency and traceability; (2) reducing hallucinations by integrating knowledge bases, retrieval-augmented generation, and verification mechanisms to bolster decision reliability; and (3) standardizing data formats to strengthen cross-modal fusion and reasoning. These measures will improve system stability and efficiency, providing solid support for the advancement of smart agriculture.