Vaswani等

[15]引入自注意力机制(Self-attention),提出了Transformer神经网络架构,最初在自然语言处理(Natural Language Processing, NLP)领域表现突出,后逐步引入时间序列预测,但存在方法可解释性局限

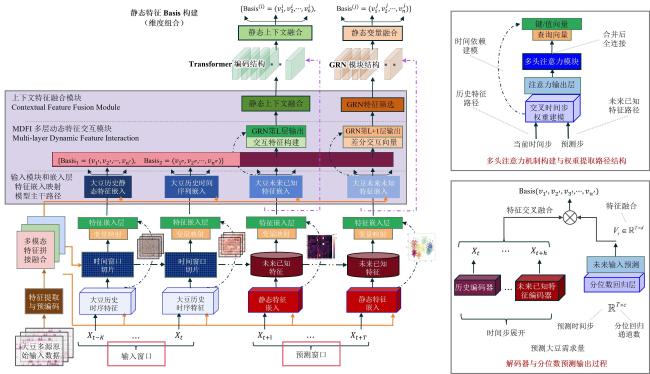

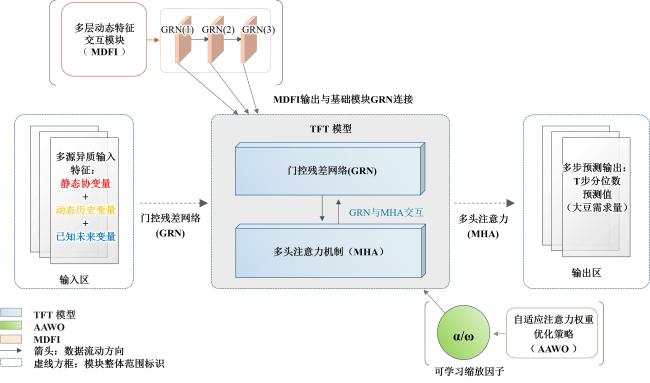

[16]。时间融合Transformers(Temporal Fusion Transformers, TFT)是一种改进架构的Transformer模型

[17],融合了Transformer的注意力机制与门控循环单元(Gated Recurrent Unit, GRU)/长短期记忆网络(Long Short-Term Memory, LSTM)的时间序列建模能力,同时引入门控机制、变量选择网络和分位数预测等创新组件,形成兼具高精度与可解释性的多步时间序列预测。目前,国内外学者已将TFT引入到医疗

[18]、旅游

[19]、电力

[20]、电商

[21]、宏观经济

[22]、农产品价格

[23]等领域开展预测应用研究。相关研究结果表明,TFT作为一种强大的时间序列预测工具,具有多模态数据处理能力和较好的可解释性。为了解决不同领域的实践应用问题,许多研究注重将TFT与领域知识深度结合,聚焦于模型架构轻量化、超参数优化、损失函数增强、多模型混合集成等方向开展TFT模型优化研究。Li等

[24]将小时负荷的原始单变量时间序列重建为不同小时点的多个每日负荷时间序列,并将TFT中的LSTM替换为GRU,降低模型复杂度并提高长期依赖学习效率。曾宇容等

[25]利用差分进化算法优化TFT参数,实验表明百度“疫情”指数对玉米期货价格影响显著,模型可解释性输出识别出生猪价格、国际油价为关键滞后变量。Mazen等

[26]在提出的GRU-TFT模型中引入了DILATE(Distortion Loss Including Shape and Time)损失函数,专门用于训练所提出的多步非平稳时间序列预测。Qi等

[27]融合了TFT与DeepAR概率预测模型,通过多目标优化算法(Multi-objective Salp Swarm Algorithm, MSSA)确定最优融合参数,提升了金融时间序列的点预测与区间预测性能。Tao

[28]提出了一种集GRU、ARIMA和TFT的混合网络模型,通过对不同数据集的实验结果分析,证明了该混合模型在提高预测精度和理解复杂交通模式方面具有显著优势。Ho和Hung

[29]提出了一种基于完全集成经验模态分解(Complete Ensemble Empirical Mode Decomposition, CEEMD)与TFT的多变量金融时间序列预测框架,较一般TFT模型精度提升达33.72%。