0 引 言

1 研究区概况及数据源

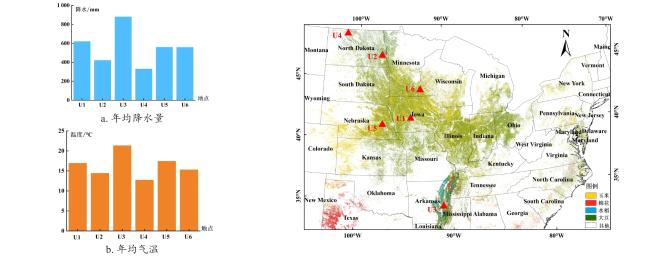

1.1 研究区概况

1.2 数据源

1.2.1 Sentinel-2影像

表1 2021—2023年构建大豆遥感识别模型在各个地点使用的Sentinel-2数据Table 1 Sentinel-2 data used for soybean remote sensing identification model across various locations from 2021 to 2023 |

| 地点 | 影像日期 | 影像数量/景 |

|---|---|---|

| 2021年8月24日 | 4 | |

| Dallas | 2022年9月13日 | 4 |

| 2023年8月22日 | 4 | |

| 2021年8月23日 | 4 | |

| Cass | 2022年8月30日 | 4 |

| 2023年8月25日 | 4 | |

| 2021年9月7日 | 4 | |

| Phillips | 2022年9月12日 | 4 |

| 2023年8月18日、8月21日 | 6 | |

| 2021年8月16日 | 4 | |

| Renville | 2022年8月14日 | 4 |

| 2023年8月29日 | 4 | |

| 2021年9月6日、9月9日 | 4 | |

| Bulter | 2022年8月30日 | 2 |

| 2023年8月22日、8月30日 | 4 | |

| 2021年9月16日、9月18日 | 8 | |

| Dodge | 2022年9月3日 | 4 |

| 2023年9月1日、9月3日 | 6 |

1.2.2 样本数据

表2 2022年构建大豆遥感识别模型在各地点所使用的样本数量Table 2 Number of samples used at each location for constructing the soybean remote sensing identification model in 2022 |

| 地点 | 训练样本/个 | 验证样本/个 | ||

|---|---|---|---|---|

| 大豆 | 非大豆 | 大豆 | 非大豆 | |

| Dallas | 10 500 | 15 225 | 4 466 | 6 463 |

| Cass | 48 300 | 62 999 | 20 645 | 26 870 |

| Phillips | 16 612 | 11 550 | 8 919 | 4 916 |

| Renville | 7 800 | 46 199 | 3 271 | 19 629 |

| Bulter | 12 600 | 17 850 | 5 337 | 7 551 |

| Dodge | 9 450 | 15 748 | 3 980 | 6 586 |

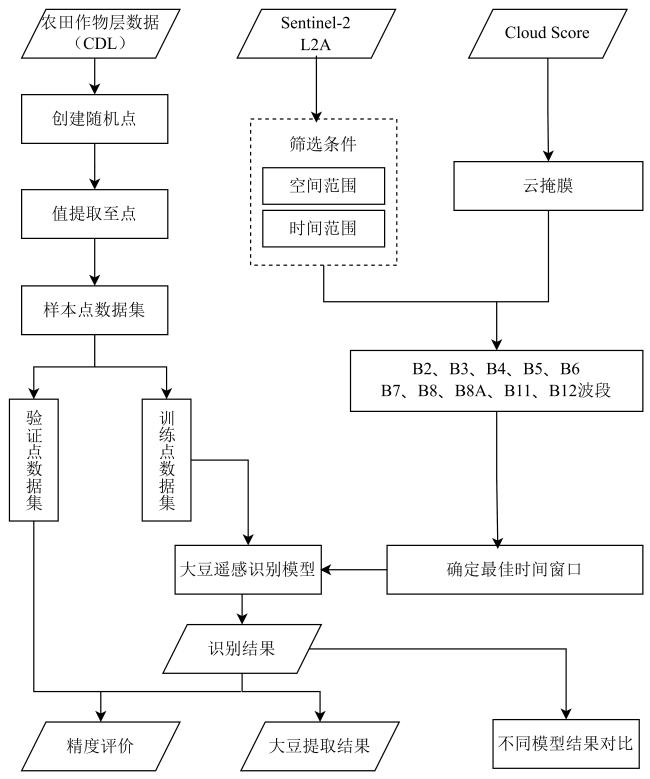

2 研究方法

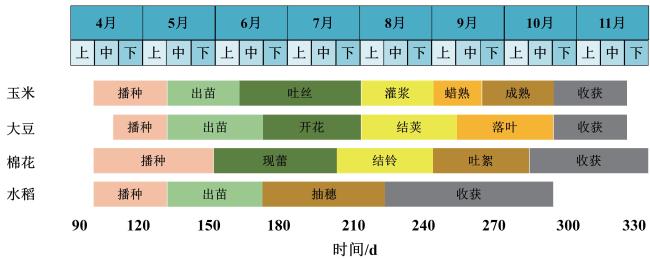

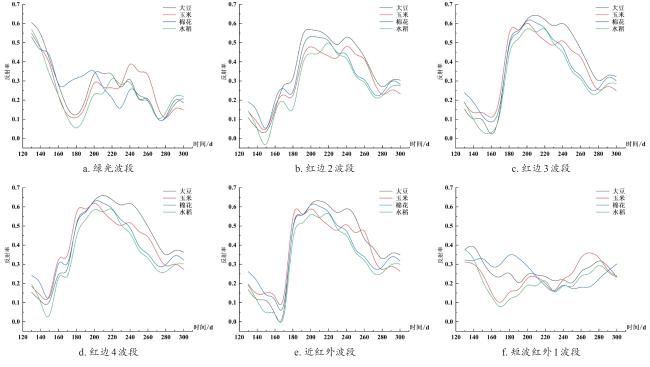

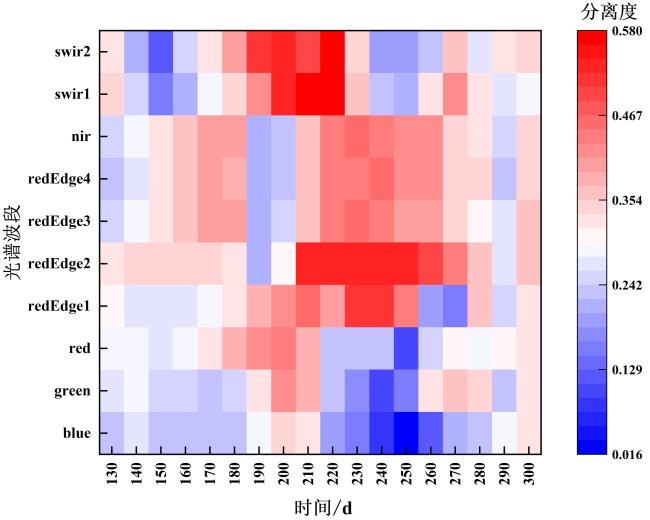

2.1 大豆识别最佳时间窗口的确定

2.2 Logistic模型

2.3 精度评价指标

3 结果与分析

3.1 模型构建结果

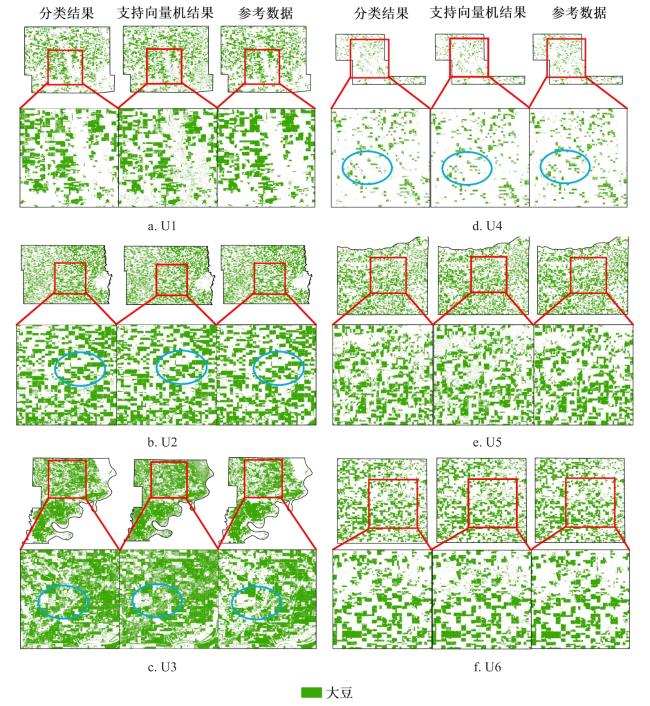

3.2 大豆分类结果

表3 2022年各个地点大豆遥感识别模型结果的混淆矩阵Table 3 Confusion matrix for soybean remote sensing identification models across locations in 2022 |

| 地点 | 类别 | 非大豆 | 大豆 | 总量 | 用户精度 |

|---|---|---|---|---|---|

| U1 | 非大豆 | 6 081 | 680 | 6 761 | 0.89 |

| 大豆 | 382 | 3 786 | 4 168 | 0.90 | |

| 总量 | 6 463 | 4 466 | 10 929 | — | |

| 生产者精度 | 0.94 | 0.85 | — | — | |

| 总体精度 | 0.90 | ||||

| Kappa | 0.79 | ||||

| U2 | 非大豆 | 24 751 | 2 887 | 27 638 | 0.89 |

| 大豆 | 2 119 | 17 758 | 19 877 | 0.89 | |

| 总量 | 26 870 | 20 645 | 47 515 | — | |

| 生产者精度 | 0.92 | 0.86 | — | — | |

| 总体精度 | 0.89 | ||||

| Kappa | 0.78 | ||||

| U3 | 非大豆 | 3 775 | 1 901 | 5 676 | 0.66 |

| 大豆 | 1 141 | 7 018 | 8 159 | 0.86 | |

| 总量 | 4 916 | 8 919 | 13 835 | — | |

| 生产者精度 | 0.76 | 0.78 | — | — | |

| 总体精度 | 0.78 | ||||

| Kappa | 0.70 | ||||

| U4 | 非大豆 | 19 087 | 933 | 20 020 | 0.95 |

| 大豆 | 542 | 2 338 | 2 880 | 0.81 | |

| 总量 | 19 629 | 3 271 | 22 900 | — | |

| 生产者精度 | 0.97 | 0.71 | — | — | |

| 总体精度 | 0.93 | ||||

| Kappa | 0.72 | ||||

| U5 | 非大豆 | 6 868 | 947 | 7 815 | 0.87 |

| 大豆 | 683 | 4 390 | 5 073 | 0.86 | |

| 总量 | 7 551 | 5 337 | 12 888 | — | |

| 生产者精度 | 0.90 | 0.82 | — | — | |

| 总体精度 | 0.87 | ||||

| Kappa | 0.73 | ||||

| U6 | 非大豆 | 6 202 | 326 | 6 528 | 0.95 |

| 大豆 | 384 | 3 654 | 4 038 | 0.90 | |

| 总量 | 6 586 | 3 980 | 10 566 | — | |

| 生产者精度 | 0.94 | 0.91 | — | — | |

| 总体精度 | 0.93 | ||||

| Kappa | 0.85 | ||||

|

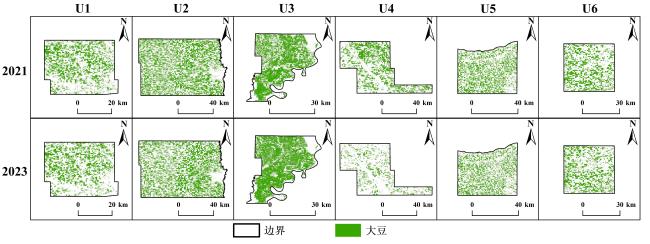

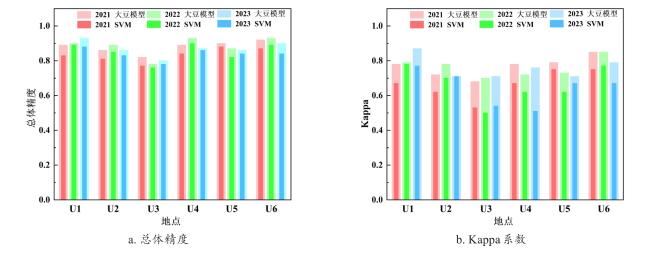

3.3 模型多年稳定性和可移植性测试结果

表4 2021年大豆遥感识别模型结果的混淆矩阵Table 4 Confusion matrix for soybean remote sensing identification models in 2021 |

| 地点 | 类别 | 非大豆 | 大豆 | 总量 | 用户精度 |

|---|---|---|---|---|---|

| U1 | 非大豆 | 4 082 | 572 | 4 654 | 0.87 |

| 大豆 | 412 | 3 921 | 4 333 | 0.90 | |

| 总量 | 4 494 | 4 493 | 8 987 | — | |

| 生产者精度 | 0.90 | 0.87 | — | — | |

| 总体精度 | 0.89 | ||||

| Kappa | 0.78 | ||||

| U2 | 非大豆 | 19 609 | 2 992 | 22 601 | 0.86 |

| 大豆 | 2 891 | 17 258 | 20 149 | 0.85 | |

| 总量 | 22 500 | 20 250 | 42 750 | — | |

| 生产者精度 | 0.87 | 0.85 | — | — | |

| 总体精度 | 0.86 | ||||

| Kappa | 0.72 | ||||

| U3 | 非大豆 | 3 548 | 1 234 | 4 782 | 0.74 |

| 大豆 | 947 | 6 387 | 7 334 | 0.87 | |

| 总量 | 4 495 | 7 621 | 12 116 | — | |

| 生产者精度 | 0.78 | 0.83 | — | — | |

| 总体精度 | 0.82 | ||||

| Kappa | 0.68 | ||||

| U4 | 非大豆 | 21 856 | 1 436 | 23 292 | 0.93 |

| 大豆 | 2 444 | 12 064 | 14 508 | 0.83 | |

| 总量 | 24 300 | 13 500 | 37 800 | — | |

| 生产者精度 | 0.89 | 0.89 | — | — | |

| 总体精度 | 0.89 | ||||

| Kappa | 0.78 | ||||

| U5 | 非大豆 | 7 026 | 744 | 7 770 | 0.90 |

| 大豆 | 522 | 4 597 | 5 119 | 0.89 | |

| 总量 | 7 548 | 5 341 | 12 889 | — | |

| 生产者精度 | 0.93 | 0.86 | — | — | |

| 总体精度 | 0.90 | ||||

| Kappa | 0.79 | ||||

| U6 | 非大豆 | 5 372 | 451 | 5 823 | 0.92 |

| 大豆 | 276 | 3 910 | 4 186 | 0.93 | |

| 总量 | 5 648 | 4 361 | 10 009 | — | |

| 生产者精度 | 0.95 | 0.89 | — | — | |

| 总体精度 | 0.92 | ||||

| Kappa | 0.85 | ||||

|

表5 2023年大豆遥感识别模型的混淆矩阵Table 5 Confusion matrix for soybean remote sensing identification models in 2023 |

| 地点 | 类别 | 非大豆 | 大豆 | 总量 | 用户精度 |

|---|---|---|---|---|---|

| U1 | 非大豆 | 5 525 | 367 | 5 892 | 0.93 |

| 大豆 | 260 | 3 957 | 4 217 | 0.93 | |

| 总量 | 5 785 | 4 324 | 10 109 | — | |

| 生产者精度 | 0.95 | 0.91 | — | — | |

| 总体精度 | 0.93 | ||||

| Kappa | 0.87 | ||||

| U2 | 非大豆 | 20 954 | 3 204 | 24 158 | 0.86 |

| 大豆 | 2 806 | 16 099 | 18 905 | 0.85 | |

| 总量 | 23 760 | 19 303 | 43 063 | — | |

| 生产者精度 | 0.88 | 0.83 | — | — | |

| 总体精度 | 0.86 | ||||

| Kappa | 0.71 | ||||

| U3 | 非大豆 | 3 348 | 1 203 | 4 551 | 0.73 |

| 大豆 | 1 116 | 5 927 | 7 043 | 0.84 | |

| 总量 | 4 464 | 7 130 | 11 594 | — | |

| 生产者精度 | 0.75 | 0.83 | — | — | |

| 总体精度 | 0.80 | ||||

| Kappa | 0.71 | ||||

| U4 | 非大豆 | 15 932 | 1 516 | 17 448 | 0.91 |

| 大豆 | 1 022 | 2 269 | 3 291 | 0.68 | |

| 总量 | 16 954 | 3 785 | 20 739 | — | |

| 生产者精度 | 0.93 | 0.59 | — | — | |

| 总体精度 | 0.87 | ||||

| Kappa | 0.76 | ||||

| U5 | 非大豆 | 6 405 | 914 | 7 319 | 0.87 |

| 大豆 | 701 | 3 990 | 4 691 | 0.85 | |

| 总量 | 7 106 | 4 904 | 12 010 | — | |

| 生产者精度 | 0.90 | 0.81 | — | — | |

| 总体精度 | 0.86 | ||||

| Kappa | 0.77 | ||||

| U6 | 非大豆 | 5 358 | 534 | 5 892 | 0.90 |

| 大豆 | 397 | 3 142 | 3 539 | 0.88 | |

| 总量 | 5 755 | 3 676 | 9 431 | — | |

| 生产者精度 | 0.93 | 0.85 | — | — | |

| 总体精度 | 0.89 | ||||

| Kappa | 0.79 | ||||

|