1 引 言

国内外众多学者对葡萄的识别采摘展开了研究。早在1995年,Kondo等[4-6]提出一种多功能葡萄农业机器人,利用果穗的光谱反射及形状识别检测葡萄,但光谱反射受外界湿度、天气等因素影响,约束条件复杂,在自然环境中葡萄识别准确度波动较大。Liu等[7]结合颜色与纹理特征对葡萄进行识别试验,准确率为88%。Reis等[8]基于彩色葡萄图像识别分类红、白葡萄,其成功率分别为97%和91%。雷旺雄与卢军[9]利用YUV颜色模型中的U分量实现葡萄串的分类,并利用角点检测算法实现葡萄采摘点的定位。Perez-zavala等[10]利用纹理与形状给特征,并结合聚类算法实现葡萄的识别。由于葡萄与枝干、枯叶像素值相近,且伴随外界光照等环境因素影响,其特定颜色准则波动范围较大,以上研究普适性低。Berenstein等[11]利用统计学测量与形状匹配算法实现葡萄分割定位,识别成功率达90%。刘平等[12]对自然环境下贴叠葡萄进行了识别分割,识别分割成功率为89.71%。Miao等[13]运用边缘检测和轮廓拟合实现重叠葡萄果粒的检测与数据测量,平均误差率为1.5%;并进一步地实现贴叠葡萄的采摘点定位[14]。相较定位葡萄采摘点而言,这些葡萄的识别与分割相对简单,且由于葡萄的形态多变,导致葡萄采摘点定位难度远大于葡萄的分割与识别。

目前,有学者对葡萄类簇状果实采摘点的定位展开研究。罗陆锋等[15]利用HIS彩色空间中的H分量进行葡萄识别,结合重心确定采摘点,定位成功率为88.03%。Xiong等[16]旋转RGB颜色通道中的R分量,结合一种改进的Chan-Vese(C-V)水平模型方法进行葡萄背景分离,利用最小外接矩阵与霍夫直线检测定位采摘点,识别精度为80%~92.5%。利用单一颜色通道实现的目标识别与分割受外界扰动影响严重,自然环境中准确率降低。进一步地,熊俊涛等[17]对非结构环境下的扰动葡萄进行研究,通过Otsu阈值分割得到果实果梗,利用点线结合和霍夫直线拟合进行采摘点识别,但是由于葡萄果梗与果实、枯叶、枝干、叶子之间的颜色相近,阈值分割较难达到预期效果,定位采摘点准确率仅为80%。Luo等[18]提出了一种基于双目立体视觉的葡萄串空间信息获取方法,实现葡萄串的快速定位,但准确率仅为87%。袁妍[19]提出一种基于深度视觉的棚架葡萄采摘机器人手眼系统,利用深度相机获得图像并进行背景分离,通过深度点云实现葡萄果梗与果穗的分离,然而其目标葡萄要求无遮挡,且葡萄果穗的高度近似一致,自然环境下葡萄难以满足其实施条件。

近年来,深度学习的发展为水果的识别及采摘点的定位带来新的机遇,罗庆等[20]改进YOLOv5s算法实现了毛桃及套袋桃的识别与检测。同期,商枫楠等[21]利用改进的YOLOX实现自然环境中的火龙果快速检测;周文静等[22]利用Mask R-CNN实现红提葡萄果穗的背景分离,并通过Hough进行果粒分割。宁政通等[23]利用Mask R-CNN进行葡萄果梗的识别与分割,最终利用区域生长算法精准分割果梗实现采摘点定位,准确率达99.43%。孙碧玉[24]改进Cascade RCNN网络与E-Net网络,实现重叠番茄串的准确分割。然而采用深度学习方法需花费大量的时间与精力完成图像标注,且深度学习在网络训练过程以及移动端的部署时对设备性能要求较高,成本较高。

针对上述问题,本研究基于改进的K-means聚类算法和轮廓分析法提出了一种鲜食葡萄采摘点自动定位方法,提高鲜食葡萄采摘点定位鲁棒性和精度,为鲜食葡萄采摘机器人实现精准采摘葡萄提供理论支撑。

2 数据与材料

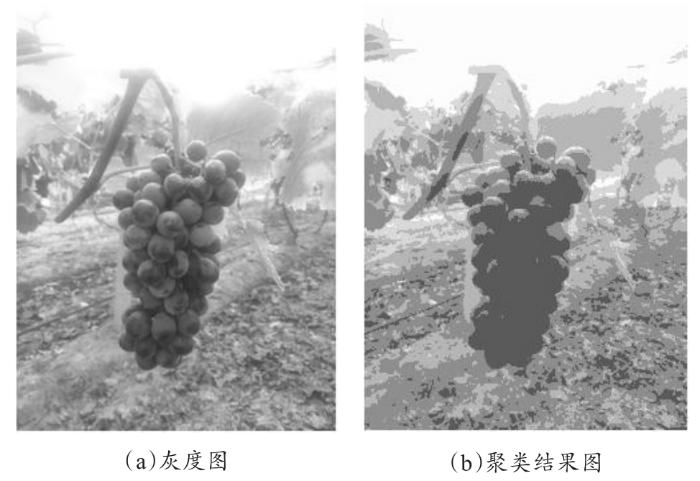

2019年10月18日上午07∶30~11∶30,于山东省果蔬研究所金牛山基地(117.18°E,36.16°N)采集鲜食葡萄图像(如图1),天气晴,气温12~23℃。葡萄品种为夏黑、摩尔多瓦、尤勇,相机采用MI8手机的后置摄像头,采集图像约1200万像素(3024×4032),水平与垂直分辨率为72 dpi,光圈值为f/1.8,曝光时间为1/100 s,共拍摄图像917张。获得的图像由于像素较高,后期图像处理过程中耗费时间较长,因此采用临近插值算法将图像缩放至原图像的0.08倍,像素约为7.8万(242×322),提高算法运行速度与实用性。

图1

3 研究方法

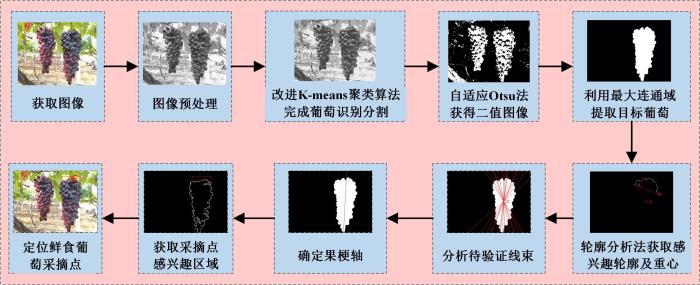

首先采用加权灰度阈值作为聚类算法相似度的判定依据,并以此为基础提出一种自适应调整K值的K-means聚类算法,实现鲜食葡萄的快速有效分割。其次利用自适应阈值算法获得鲜食葡萄二值化图像,并根据形态学处理、填充孔洞等操作进行除噪,最终基于最大连通域获得精准目标鲜食葡萄图像及其轮廓。然后利用改进的轮廓分析法获得果梗轴和采摘点感兴趣区域,并利用几何方法实现鲜食葡萄采摘点快速准确定位。鲜食葡萄采摘点的定位算法流程如图2所示。

图2

图2

鲜食葡萄采摘点定位流程图

Fig. 2

Flowchart of picking point positioning for table grapes

3.1 鲜食葡萄的检测方法

3.1.1 鲜食葡萄的聚类分割

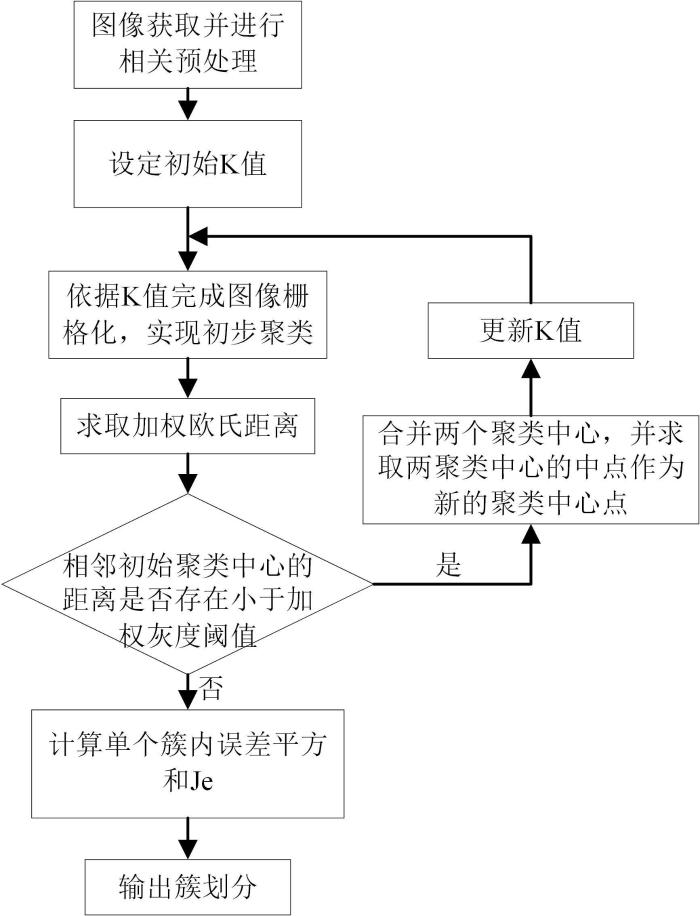

针对上述问题,本研究对K-means进行改进,提出一种可自适应改变的K值和加权灰度阈值

图3

图3

改进K-means后聚类算法流程图

Fig. 3

Flow chart of improved K-means clustering algorithm

基于K-means算法的聚类原理,首先将RGB图像转为灰度图像,并设定初始K值。然后按照灰度等级对灰度图像进行K个簇的划分,且单个簇中灰度等级像素数最多的任意点作为初始聚类的中心点,当完成首次聚类后,获得聚类后每个簇的聚类中心点平面坐标信息,为提高聚类准确率,根据

其中,

需要注意,当

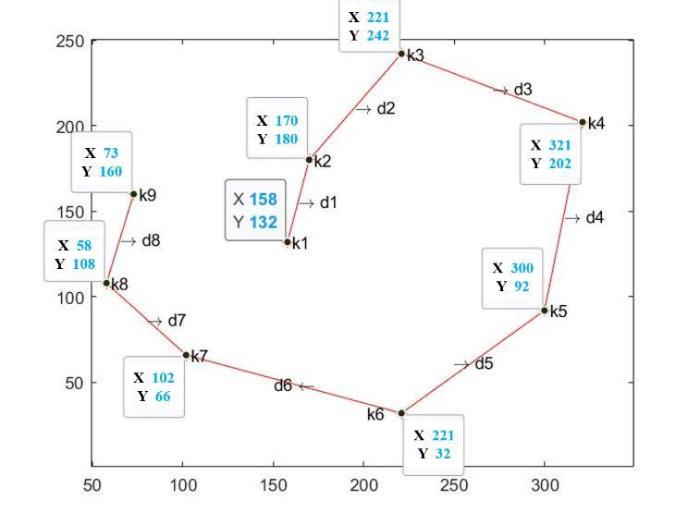

当图像栅格化完成后,获得初始聚类簇及初始聚类中心(见图4)。并通过

图4

图4

鲜食葡萄图像的初始聚类中心及坐标信息

Fig. 4

Initial cluster center and its coordinate information for images of table grape

其中,

为提高聚类算法的鲁棒性,参照

经多次试验,并对试验数据进行统计分析,发现

通过两个相邻簇的聚类中心的灰度差值

其中,

图5

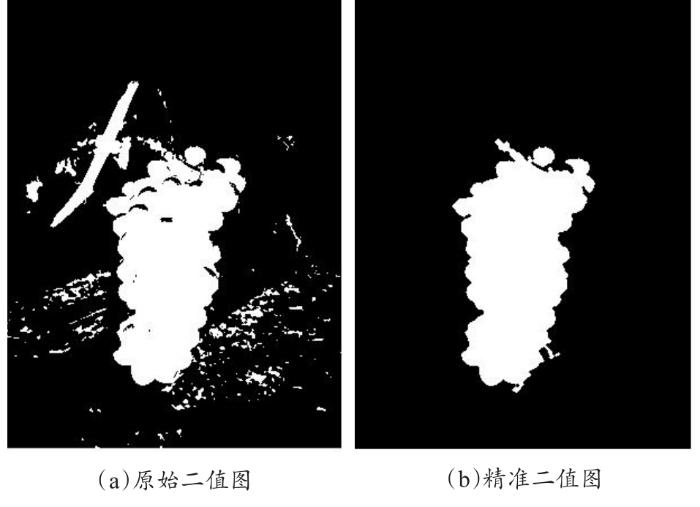

3.1.2 目标葡萄的获取

图6

3.2 采摘点的定位方法

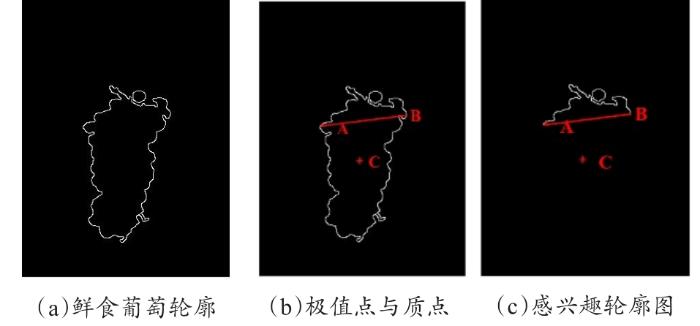

3.2.1 轮廓分析法

其中,以图像左上角为原点,纵向为Y轴正方向,横向为X轴正方向;

图7

图7

鲜食葡萄的轮廓及轮廓信息图

Fig. 7

Contour and contour information image of table grapes

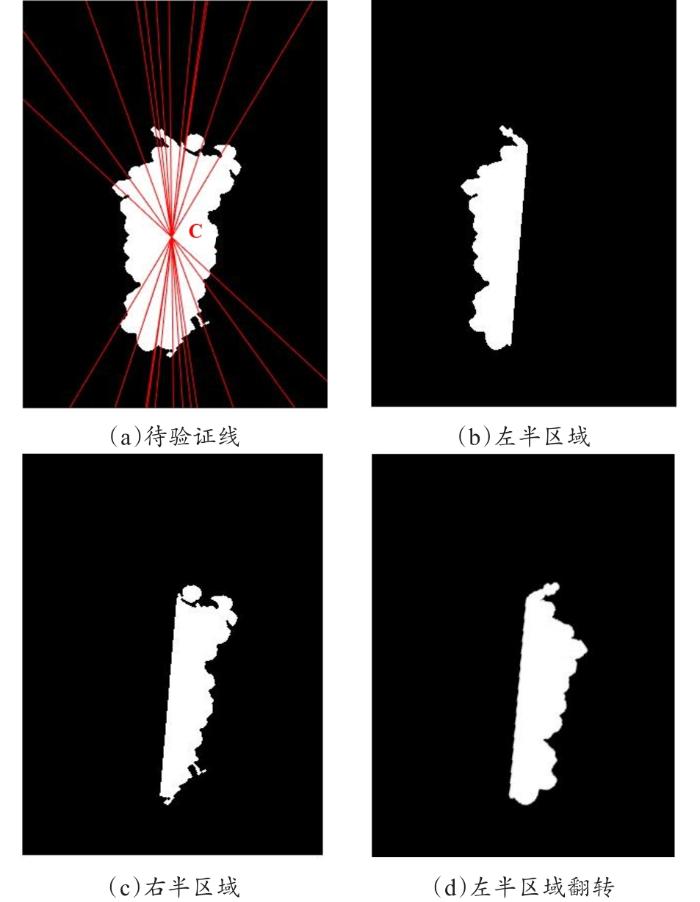

3.2.2 果梗轴的获取

图8

图8

鲜食葡萄的待验证线束及果梗轴

Fig. 8

Images of lines bundles of the stem axis to be verified

其中,P为待验证线右半区域与翻转后的左半区域的像素的相似度值;

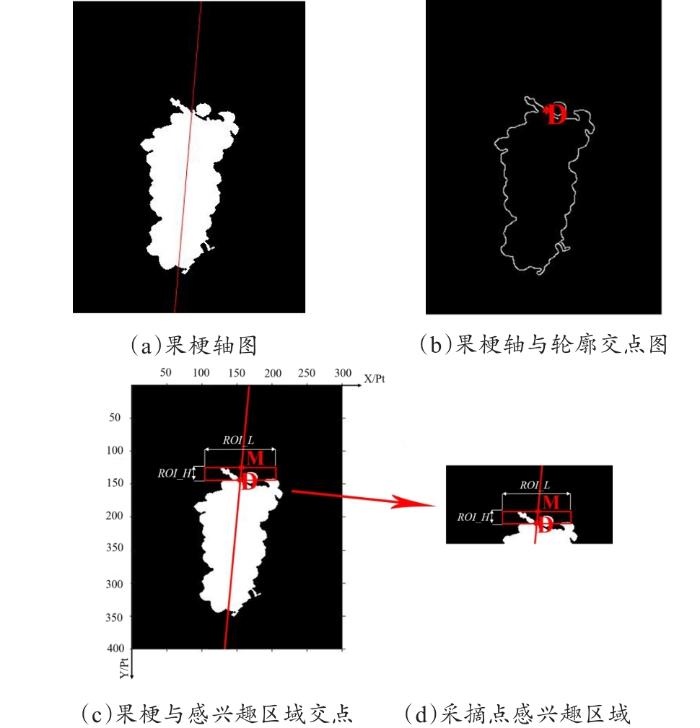

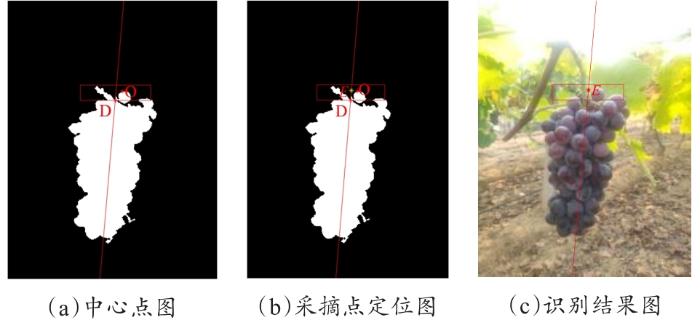

3.2.3 目标葡萄采摘点的定位

图9

图9

鲜食葡萄采摘点感兴趣轮廓图

Fig. 9

Region of interest of picking point for table grapes

其中,采摘点感兴趣区域所在位置的两个约束条件如下:①点D为感兴趣区域矩形底边必过点;②点D为感兴趣区域矩形底边中点。依据

图10

图10

鲜食葡萄的采摘点识别结果图

Fig. 10

Recognition results of picking point for table grapes

其中,

定位采摘点E的两种情况为:①中心O位于果梗轴外,求取果梗轴至点O的最短距离的点E,并将点E作为最终采摘点;②中心O位于果梗轴上,将点O作为采摘点。

4 结果与分析

4.1 试验数据与误差分析

采用像素定位误差[15]方法分析采摘点定位的准确度,并通过采摘点像素定位误差e评价采摘点定位的精准度,如

其中,X为最优采摘点像素区域横坐标;Y为最优采摘点像素区域纵坐标;x为所求的采摘点横坐标;y为所求的采摘点纵坐标;ex 为得到的采摘点到最优采摘点像素区域的行方向坐标误差;ey 为得到的采摘点到最优采摘点像素区域的列方向误差;e为采摘点像素定位误差。

为保证试验数据真实有效,最优采摘点的坐标范围选自采摘点感兴趣区域内的果梗直线所在区域,根据点D和点M人工设置最优采摘点的坐标范围,以点D和点M的中点为基点,在像素6×30范围内为最优采摘点的区域;计算本研究所提出方法定位的采摘点与人工确定的最优采摘点之间的误差。

表1 目标葡萄的聚类信息

Table 1

| 样本号 | 初始K值 | 最终K值 | 改进前聚类时间/s | 改进后聚类时间/s | 改进前目标簇的误差平方和 | 改进后目标簇的误差平方和 | |

|---|---|---|---|---|---|---|---|

| 1 | 18 | 7 | 2.65 | 0.66 | 0.0101 | 0.0098 | |

| 2 | 20 | 8 | 3.23 | 0.77 | 0.0092 | 0.0110 | |

| 3 | 19 | 7 | 2.35 | 0.65 | 0.0083 | 0.0083 | |

| 4 | 20 | 7 | 2.21 | 0.58 | 0.0053 | 0.0066 | |

| 5 | 21 | 4 | 3.68 | 1.40 | 0.0122 | 0.0115 | |

| 6 | 21 | 6 | 2.68 | 0.67 | 0.0152 | 0.0147 | |

| 7 | 18 | 3 | 2.64 | 0.64 | 0.0110 | 0.0113 | |

| 8 | 18 | 8 | 2.69 | 0.65 | 0.0115 | 0.0101 | |

| 9 | 20 | 9 | 3.01 | 0.63 | 0.0093 | 0.0100 | |

| 10 | 20 | 8 | 3.77 | 1.26 | 0.0082 | 0.0090 | |

表2 鲜食葡萄采摘点定位信息表

Table 2

| 样本号 | 点D坐标 | 点M坐标 | 最优采摘点范围 | 点E坐标 | 与最优采摘点的误差 | 运行时间/s | ||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| X | Y | x | y | ex | ey | e | ||||||

| 1 | (157,145) | (155,122) | 155 | 133 | 146 | 128 | 9 | 5 | 10.3 | 0.68 | ||

| 2 | (155,133) | (153,116) | 153 | 124 | 148 | 119 | 5 | 5 | 7.1 | 0.78 | ||

| 3 | (160,143) | (159,116) | 159 | 129 | 155 | 133 | 4 | 4 | 5.7 | 0.66 | ||

| 4 | (142,52) | (142,19) | 142 | 35 | 149 | 40 | 7 | 5 | 8.6 | 0.59 | ||

| 5 | (152,115) | (151,91) | 151 | 102 | 136 | 134 | 15 | 32 | 35.3 | 1.42 | ||

| 6 | (172,149) | (169,1230) | 170 | 135 | 176 | 139 | 6 | 4 | 7.2 | 0.68 | ||

| 7 | (163,38) | (161,7) | 161 | 22 | 165 | 28 | 4 | 6 | 7.2 | 0.65 | ||

| 8 | (155,26) | (156,-14) | 155 | 6 | 148 | 13 | 7 | 7 | 9.9 | 0.67 | ||

| 9 | (204,187) | (204,172) | 204 | 179 | 199 | 170 | 5 | 9 | 10.3 | 0.64 | ||

| 10 | (209,55) | (208,20) | 208 | 37 | 201 | 43 | 7 | 6 | 9.2 | 1.28 | ||

图11

4.2 对比分析

对本研究提出的算法进行对比分析,主要对改进后的K-means算法与初始K-means算法进行对比,结果如图12所示。其中图12(a)为初始K-means聚类算法的聚类与定位失败案例,由于采取欧式距离作为聚类结果的评判标准,聚类迭代次数多,聚类过程计算复杂,导致聚类时间较长。通过统计,初始K-means聚类算法的平均聚类时间为2.37 s;由于K值的为固定值,导致聚类结果有较多不确定性,如图12(a)与图12(b)都为同一张图像初始K-means聚类的聚类及定位结果。分析发现,由于K值的固定性以及位置的随机性导致聚类结果的差异性较大,难以适应多种环境下的鲜食葡萄检测及定位,影响后续定位的精度及准确率。而本研究提出的算法中,图像栅格化在节约了大量时间的同时,也完成了适用于相应图像的K值赋值与部署,同时采取灰度阈值作为评判标准,在保证精度的前提下,极大提高聚类速度,为采摘点快速定位提供基础,图12(c)为改进K-means后的聚类与定位结果。

图12

图12

改进K-means方法的结果对比图

(a)初始聚类与定位失败案例 (b)初始聚类与定位成功案例 (c)改进聚类与定位成功案例

Fig.12

Contrasting results of improved K-means method

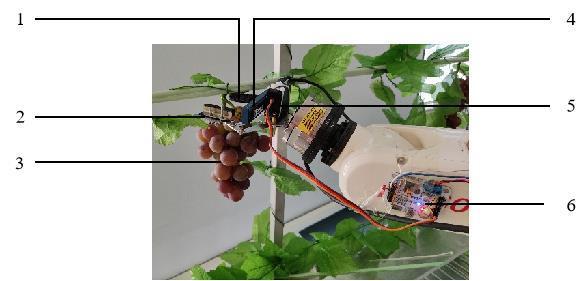

4.3 模拟试验

模拟试验以Denso机械臂为平台,以32单片机为控制核心,如图13所示,在模拟环境下验证本研究所提出的方法。试验结果如图14所示,定位数据如表3,在篱壁式种植方式与棚架式种植方式下分别进行50次模拟试验,结果表明,篱壁式紫葡萄采摘点定位成功率为86.00%,棚架式紫葡萄识别定位成功率达到92.00%,篱壁式绿葡萄采摘点定位成功率为78.00%,棚架式绿葡萄识别定位成功率为80.00%,整体试验效果较好。进一步分析发现,由于篱壁式葡萄受枝叶的干扰(遮挡、支撑等),致使篱壁式葡萄采摘点识别成功率略低于棚架式葡萄采摘点识别成功率;由于绿色葡萄受光照及枝叶遮挡影响较为严重(如图14(d)),因此绿葡萄定位采摘成功率明显低于紫葡萄定位成功率,但仍满足多数情况下的采摘点定位。

图13

图13

鲜食葡萄采摘试验平台

Fig.13

Picking test platform of table grapes

图14

表3 鲜食葡萄采摘模拟试验数据

Table 3

| 种植模式 | 试验次数 | 成功率/% | 平均时间/s |

|---|---|---|---|

| 篱壁式紫葡萄 | 50 | 86.00 | 0.89 |

| 棚架式紫葡萄 | 50 | 92.00 | 0.67 |

| 篱壁式绿葡萄 | 50 | 78.00 | 0.72 |

| 棚架式绿葡萄 | 50 | 80.00 | 0.71 |

5 结论与讨论

本研究基于改进的K-means聚类算法和轮廓分析法提出了一种鲜食葡萄采摘点自动定位的方法,实现自然环境中鲜食葡萄的快速准确定位,具体内容如下:

(1)改进K-means聚类算法。采用加权灰度阈值作为聚类算法相似度的判定依据,并以此为基础提出一种自适应调整K值的K-means聚类算法,满足自然环境中鲜食葡萄的聚类要求,实现鲜食葡萄的快速有效分割。

(2)提出一种基于轮廓分析与点线结合的鲜食葡萄采摘点定位方法。通过轮廓分析法获得果梗轴感兴趣区域,并利用相似度P值定位果梗轴所在直线;进一步利用轮廓分析与点线结合法获得采摘点感兴趣区域,最终快速准确地定位采摘点。

(3)以夏黑、摩尔多瓦及尤勇等鲜食葡萄进行算法验证,结果表明,本研究所提出的方法获得的鲜食葡萄采摘点与最优采摘点的误差小于12个像素的平均成功率为90.51%,平均定位时间0.87 s。 (4)经模拟试验验证,篱壁式紫葡萄采摘点定位成功率为86.00%,棚架式紫葡萄识别定位成功率达到92.00%,篱壁式绿葡萄采摘点定位成功率为78.00%,棚架式绿葡萄识别定位成功率为80.00%,整体试验效果较好,表明所提出的方法能够快速准确地实现鲜食葡萄采摘点的自动定位,为鲜食葡萄采摘机器人实现精准采摘鲜食葡萄提供理论依据。

本研究暂未考虑针对鲜食葡萄的贴叠问题,今后将针对光照及枝叶遮挡情况进行深入研究。

利益冲突声明

本研究不存在研究者以及与公开研究成果有关的利益冲突。

参考文献

果蔬采摘机器人的研究现状、问题及对策

[J].

Research status, problems and countermeasures of fruit and vegetable picking robot

[J].

果蔬采摘机器人的发展现状、问题及对策分析

[C]//

Analysis on the development status, problems and countermeasures of fruit and vegetable picking robot

[C]//

果蔬采摘机器人的研究现状、问题及对策

[J].

Research situation, problems and solutions of fruit-vegetable picking robots

[J].

Basic studies on robot to work in vineyard (Part 1) manipulator and harvesting hand

[J].

Basic studies on robot to work in vineyard (Part 2) discriminating, position detecting and harvesting experiments by using visual sensor

[J].

Basic studies on robot to work in vineyard (Part 3) measurement of physical properties for robotization and manufacture of berry thinning hand

[J].

Automatic grape bunch detection in vineyards with an SVM classifier

[J].

Automatic detection of bunches of grapes in natural environment from color images

[J].

葡萄采摘机器人采摘点的视觉定位

[J].

Visual positioning method for picking point of grape picking robot

[J].

A pattern recognition strategy for visual grape bunch detection in vineyards

[J].

Grape clusters and foliage detection algorithms for autonomous selective vineyard sprayer

[J].

自然环境下贴叠葡萄串的识别与图像分割算法

[J].

Algorithm for recognition and image segmentation of overlapping grape cluster in natural environment

[J].

A two-step phenotypic parameter measurement strategy for overlapped grapes under different light conditions

[J].

A vision methodology for harvesting robot to detect cutting points on peduncles of double overlapping grape clusters in a vineyard

[J].

自然环境下葡萄采摘机器人采摘点的自动定位

[J].

Automatic positioning for picking point of grape picking robot in natural environment

[J].

Green grape detection and picking-point calculation in a night-time natural environment using a charge-coupled device (CCD) vision sensor with artificial illumination

[J].

非结构环境中扰动葡萄采摘点的视觉定位技术

[J].

Visual localization of disturbed grape picking point in non-structural environment

[J].

Vision-based extraction of spatial information in grape clusters for harvesting robots

[J].

基于深度视觉的棚架葡萄采摘机器人手眼系统设计与果梗近景识别研究

[D].

Hand-eye system design and close-shot stem recognition for robotic harvesting of trellis grape clusters based on depth sensing

[D].

基于改进YOLOv5s和多模态图像的树上毛桃检测(英文)

[J].

Multi-class on-tree peach detection using improved YOLOv5s and multi-modal images

[J].

基于改进YOLOX的自然环境中火龙果检测方法

[J].

Detection method for dragon fruit in natural environment based on improved YOLOX

[J].

改进圆形Hough变换的田间红提葡萄果穗成熟度判别

[J].

Maturity discrimination of "Red Globe" grape cluster in grapery by improved circle Hough transform

[J].

基于深度学习的葡萄果梗识别与最优采摘定位

[J].

Recognition and the optimal picking point location of grape stems based on deep learning

[J].

基于深度学习的番茄果实目标检测和番茄串采摘点定位技术研究

[D].

Research on tomato fruit target detection and tomato string picking point location technology based on deep learning

[D].

融合K-means聚类分割算法与凸壳原理的遮挡苹果目标识别与定位方法

[J].

Recognition and localization method of occluded apples based on K-means clustering segmentation algorithm and convex hull theory

[J].

改进K-means聚类与Otsu算法的光栅投影轮廓有效点自动提取方法

[J].

Automatic extraction of effective points from fringe projection profilometry based on improved K-means clustering and Otsu algorithms

[J].

基于K均值聚类和二维Otsu的棉花HSV图像分割

[J].

Cotton HSV image segmentation based on K-means clustering and two-dimensional otsu

[J].

基于PSO与K-均值聚类算法优化结合的图像分割方法

[J].

Image segmentation method based on optimization of PSO algorithm and K-means clustering algorithm

[J].

Fruit detection for strawberry harvesting robot in non-structural environment based on Mask-RCNN

[J].